Кем пожертвовать: пассажиром или пешеходом? MIT сделал тест на моральные дилеммы, с которыми столкнутся самоуправляемые автомобили

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

ИИ теория

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Промпты. Генеративные запросы

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2016-07-02 01:26

Мораль искусственного интеллекта - один из самых обсуждаемых вопросов, связанных с наступлением эры роботов. Массачусетский технологический институт (MIT) разработал специальный тест, который помогает лучше понять, с какими моральными дилеммами сталкиваются разработчики искусственного интеллекта, а заодно разобраться со своими нравственными ориентирами.

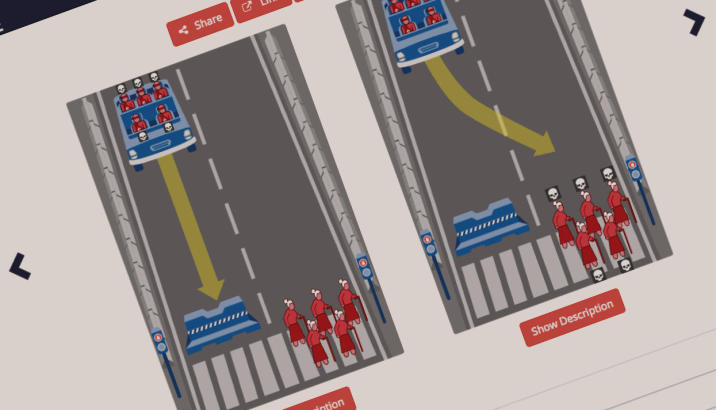

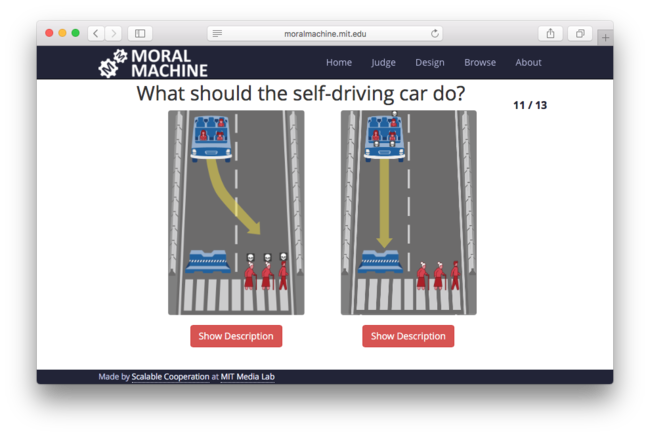

Тест очень простой. В нем надо поставить себя на место искусственного интеллекта самоуправляемой машины и выбирать, кем в ДТП можно пожертвовать - пешеходами на перекрестке или пассажирами в автомобиле. Иногда надо выбирать между тем, кого из пешеходов надо задавить, а кого - спасти.

Всего в тесте 13 вопросов. Количество пассажиров и пешеходов в некоторых задачах разное, в некоторых - одинаковое. Кроме того, отличается их возраст, пол, социальное положение. В некоторых вопросах есть домашние животные - они приравнены к другим пассажирам и пешеходам.

Для примера возьмем следующую задачу: в машине сидят женщина и двое детей (мальчик и девочка), а по пешеходному переходу идут женщина и две старушки. Необходимо выбрать, кого из них искусственному интеллекту спасать, а кем - жертвовать.

В конце теста пользователю рассказывают, кем он жертвует чаще всего и как отвечали другие люди, которые прошли тест.

На сайте MIT можно также придумать собственную моральную задачу на основе вопросов теста и посмотреть, какие вопросы поставили другие пользователи.

Когда именно MIT запустил сайт с тестом, неизвестно. Американская пресса начала писать о нем в 20-х числах июня.

Телеграм: t.me/ainewsline

Источник: meduza.io