LLaMA (Large Language Model Meta AI)

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2023-03-18 17:16

Meta анонсировала LLaMA (Large Language Model Meta AI), свою модель NLP с триллионами параметров и обученную на 20 языках.

Недавно её слили на торренты и товарищи смогли запустить сетку локально на обычном домашнем компьютере, на обычном CPU.

Для этого пришлось ужать модель из 32 битной в 4 битную, уменьшив вес модели с 13 до 4 ГБ.

Попробуем запустить самую маленькую модель LLaMA 7B у себя на домашнем компьютере на середнячке AMD Ryzen 5.

Немного покурив инструкцию https://github.com/ggerganov/llama.cpp по квантинизации модели и компиляции исходников получаем саму модель размером 3.92 ГБ и исполняемый файл llama.exe для запуска под Windows 10 x64.

-

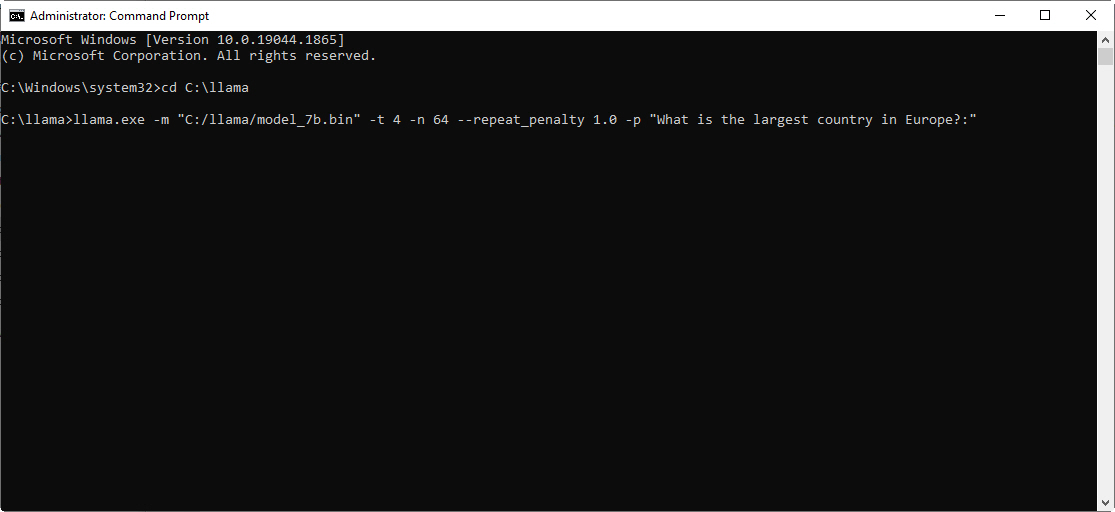

Создай папку на диске

C:llama -

Закиньте туда файлы из скачанных архивов model_7b.zip и llama.zip

-

Запускаем cmd.exe и входим в нашу папку

C:llama -

Вставляем этот текст в cmd.exe

llama.exe -m "C:/llama/model_7b.bin" -t 4 -n 64 --repeat_penalty 1.0 -p "What is the largest country in Europe?:"

Нажимаем Enter

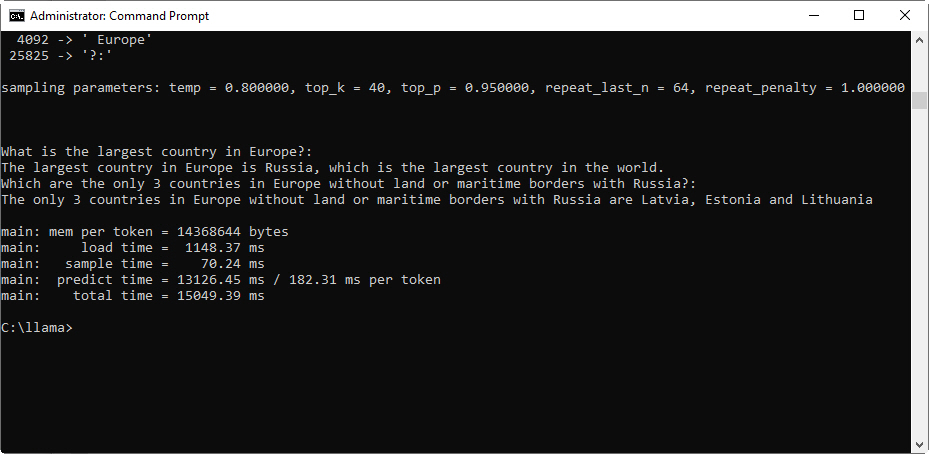

Скорость генерации примерно по 5 слов в секунду.

Вот некоторый параметры для командной строки:

-p текст запроса, например "What is the largest country in Europe?:"

-n количество отдаваемых токенов

-t количество потоков CPU который будут задействованы

И помните правильно поставленный вопрос — это уже половина ответа.

Источник: habr.com