Книга «Математика в машинном обучении»

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2023-09-07 15:25

Фундаментальные математические дисциплины, необходимые для понимания машинного обучения, — это линейная алгебра, аналитическая геометрия, векторный анализ, оптимизация, теория вероятностей и статистика. Традиционно все эти темы размазаны по различным курсам, поэтому студентам, изучающим data science или computer science, а также профессионалам в МО, сложно выстроить знания в единую концепцию.

Эта книга самодостаточна: читатель знакомится с базовыми математическими концепциями, а затем переходит к четырем основным методам МО: линейной регрессии, методу главных компонент, гауссову моделированию и методу опорных векторов.

Тем, кто только начинает изучать математику, такой подход поможет развить интуицию и получить практический опыт в применении математических знаний, а для читателей с базовым математическим образованием книга послужит отправной точкой для более продвинутого знакомства с машинным обучением.

Аналитическая геометрия

В главе 2 мы изучали векторы, векторные пространства и линейные отображения в общем, но абстрактном виде. В данной главе добавим к этим понятиям геометрическую интерпретацию и интуицию. В частности, рассмотрим геометрические векторы, научимся вычислять их длины, расстояния и углы между двумя векторами. Чтобы можно было это делать, определим на векторном пространстве внутреннее произведение, которое придает ему геометрические свойства. Внутренние произведения и соответствующие им нормы и метрики заключают в себе интуитивные представления о подобии и расстояниях, которыми мы воспользуемся в главе 12 при разработке машины опорных векторов. Затем нам понадобятся понятия длины вектора и угла между векторами, чтобы разобраться с ортогональными проекциями, которые будут в центре обсуждения анализа главных компонент в главе 10, а также регрессии и оценки максимального правдоподобия в главе 9. На рис. 3.1 показано, как связаны концепции из этой главы друг с другом и с материалом из других глав книги.

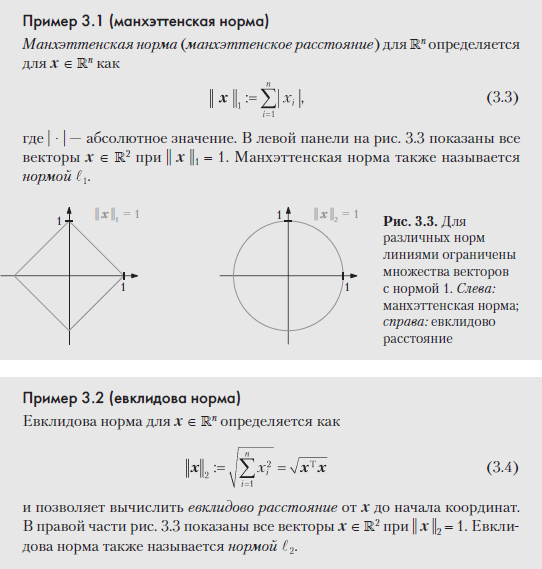

3.1. Нормы

Рассуждая о геометрических векторах, то есть о направленных отрезках, начинающихся в начале координат, мы интуитивно понимаем, что длина вектора — это расстояние от начала координат до «конца» этого отрезка. Далее мы будем обсуждать феномен длины вектора, пользуясь понятием нормы.

Определение 3.1 (норма). Норма векторного пространства V — это функция

- Абсолютная однородность: || ?x || = |?| || x ||.

- Неравенство треугольника: || x + y|| ? || x || + || y ||.

- Положительная определенность: || x || ? 0 и || x || = 0 x = 0.

По умолчанию в этой книге используется евклидова норма (3.4), если не указано иное.

3.2. Внутренние произведения

При помощи внутренних произведений (внутренним называется произведение одного вектора на другой) удобно ввести интуитивно понятные геометрические концепции, в частности длину вектора и угол или расстояние между двумя векторами. Главное назначение внутренних произведений — определять, ортогональны ли векторы друг другу.

3.2.1. Скалярное произведение

Возможно, вам уже известно об особом типе внутреннего произведения, скалярном произведении Rn, которое записывается как

3.2.2. Общие внутренние произведения

Вспомните линейное отображение из раздела 2.7, где было показано, как можно переупорядочить отображение при сложении и умножении на скаляр. Билинейное отображение ? — это отображение с двумя аргументами, и в каждом аргументе оно линейно, то есть при рассмотрении векторного пространства V для всех x, y, z ? V, ?, ? ? R верно, что

- ? называется симметричным, если ?(x, y) = ?(y, x) для всех x, y ? V, то есть порядок следования аргументов не важен.

- ? называется положительно определенным, если

- Положительно определенное, симметричное билинейное отображение ?: V ? V ? R называется внутренним произведением V. Как правило, пишут <x, y>, а не ?(x, y).

- Пара (V, <·, ·>) называется предгильбертовым пространством или (вещественным) векторным пространством с внутренним произведением. Если воспользоваться скалярным произведением, определенным в (3.5), то (V, <, ·>) называется евклидовым векторным пространством.

Такие пространства в этой книге будут называться предгильбертовыми пространствами.

3.2.3. Симметричные положительно определенные матрицы

Симметричные положительно определенные матрицы играют важную роль в машинном обучении. Они определяются при помощи внутреннего произведения. В разделе 4.3 мы вернемся к симметричным положительно определенным матрицам в контексте разложения матриц. Идея симметричных положительно полуопределенных матриц играет ключевую роль при определении ядер (раздел 12.4).

Рассмотрим n-мерное векторное пространство V с внутренним произведением <·, ·>: V ? V ? R (см. определение 3.3) и упорядоченным базисом B = (b1, ..., bn) от V. Как вы помните из раздела 2.6.1, любые векторы x, y ? V можно записать как линейную комбинацию базисных векторов, такую что

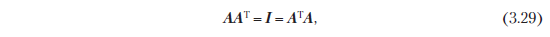

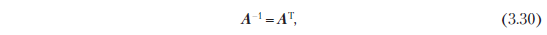

Поскольку внутреннее произведение билинейно, для всех x, y ? V верно, что

- Нулевое пространство (ядро) A состоит лишь из 0, поскольку xT Ax > 0 для всех x ? 0. Это подразумевает, что Ax ? 0 и x ? 0.

- Диагональные элементы aii от A положительны, поскольку aii = eiT Aei > 0, где ei это i-й вектор стандартного базиса в Rn.

3.3. Длины и расстояния

В разделе 3.1 мы уже обсуждали нормы, которыми можно пользоваться для вычисления длины вектора. Внутренние произведения и нормы тесно связаны в том смысле, что любое внутреннее произведение вводит норму

Для векторного пространства внутреннего произведения (V,<·, ·>) индуцированная норма || · || удовлетворяет неравенству Коши — Шварца

Подобно длине вектора, расстояние между векторами не требует внутреннего произведения; достаточно нормы. Если у вас есть норма, индуцированная внутренним произведением, то расстояние может отличаться в зависимости от выбранного внутреннего произведения.

Метрика d удовлетворяет следующим условиям:

1. d является положительно определенной, то есть d(x, y) ? 0 для всех x, y ? V и d(x, y) = 0 x = y.

2. d симметрично, то есть d(x, y) = d(y, x) для всех x, y ? V.

3. Неравенство треугольников: d(x, z) ? d(x, y) для всех x, y, z ? V.

Примечание

На первый взгляд, списки свойств внутренних произведений и метрик выглядят очень похоже. Однако если сравнить определение 3.3 с определением 3.6, то можно заменить, что <x, y> и d(x, y) действуют в противоположных направлениях. Очень схожие x и y будут давать большое значение для внутреннего произведения и малое значение для метрики.

3.4. Углы и ортогональность

Внутренние произведения позволяют не только определять длины векторов и расстояние между двумя векторами, но и схватывают геометрию векторного пространства, определяя угол ? между двумя векторами. Мы воспользуемся неравенством Коши — Шварца (3.17) для определения углов ? в пространствах внутренних произведений между двумя векторами x, y, и это определение совпадает с интуитивным пониманием R2 и R3. Предположим, что x ? 0, y ? 0. Тогда

Из этого определения следует, что 0-вектор ортогонален любому вектору в векторном пространстве.

Примечание

Ортогональность — это обобщение концепции перпендикулярности, применимой к билинейным формам, которые не обязательно дают скалярное произведение. В нашем контексте с геометрической точки зрения можно считать, что ортогональные векторы расположены под прямым углом относительно конкретного внутреннего произведения.

Более подробно с книгой можно ознакомиться на сайте издательства: » Оглавление » Отрывок По факту оплаты бумажной версии книги на e-mail высылается электронная книга. Для Хаброжителей скидка 25% по купону — Математика

Источник: habr.com