Gemini Embedding 2: Наша первая модель встраивания, изначально поддерживающая мультимодальные данные

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

ИИ теория

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Промпты. Генеративные запросы

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2026-03-13 10:57

Gemini Embedding 2 — это наша первая нативная мультимодальная модель встраивания, которая отображает текст, изображения, видео, аудио и документы в единое пространство встраивания, обеспечивая мультимодальный поиск и классификацию для различных типов медиафайлов — и она уже доступна в режиме публичного предварительного просмотра.

Сегодня мы выпускаем Gemini Embedding 2, нашу первую полностью мультимодальную модель встраивания, построенную на архитектуре Gemini, в режиме публичного предварительного просмотра через API Gemini и Vertex AI .

Развивая нашу предыдущую основу, ориентированную только на текст, Gemini Embedding 2 сопоставляет текст, изображения, видео, аудио и документы в единое, унифицированное пространство встраивания и улавливает семантические намерения на более чем 100 языках. Это упрощает сложные конвейеры обработки данных и расширяет возможности решения широкого спектра задач обработки мультимодальных данных — от генерации с расширенным поиском (Retrieval-Augmented Generation, RAG) и семантического поиска до анализа настроений и кластеризации данных.

Новые методы и гибкие параметры вывода.

Модель основана на Gemini и использует лучшие в своем классе возможности многомодального понимания для создания высококачественных эмбеддингов по следующим параметрам:

- Текст: поддерживает расширенный контекст, содержащий до 8192 входных токенов.

- Изображения: возможность обработки до 6 изображений за один запрос, поддержка форматов PNG и JPEG.

- Видео: поддерживает ввод видеофайлов продолжительностью до 120 секунд в форматах MP4 и MOV.

- Аудио: система автоматически загружает и встраивает аудиоданные без необходимости использования промежуточных текстовых транскрипций.

- Документы: прямое встраивание PDF-файлов длиной до 6 страниц.

Эта модель не только обрабатывает данные по одному типу, но и изначально понимает чередующиеся входные данные, позволяя передавать несколько типов входных данных (например, изображение + текст) в одном запросе. Это дает модели возможность улавливать сложные, тонкие взаимосвязи между различными типами медиафайлов, обеспечивая более точное понимание сложных данных из реального мира.

Как и наши предыдущие модели встраивания, Gemini Embedding 2 использует метод обучения представлению «матрёшка» (MRL), который «вкладывает» информацию, динамически уменьшая размерность. Это позволяет гибко масштабировать размерность выходных данных, начиная с 3072 по умолчанию, что дает разработчикам возможность сбалансировать производительность и затраты на хранение. Для достижения наилучшего качества мы рекомендуем использовать размерность 3072, 1536, 768.

Чтобы увидеть эти векторные представления в действии, попробуйте нашу упрощенную демонстрационную версию многомодального семантического поиска .

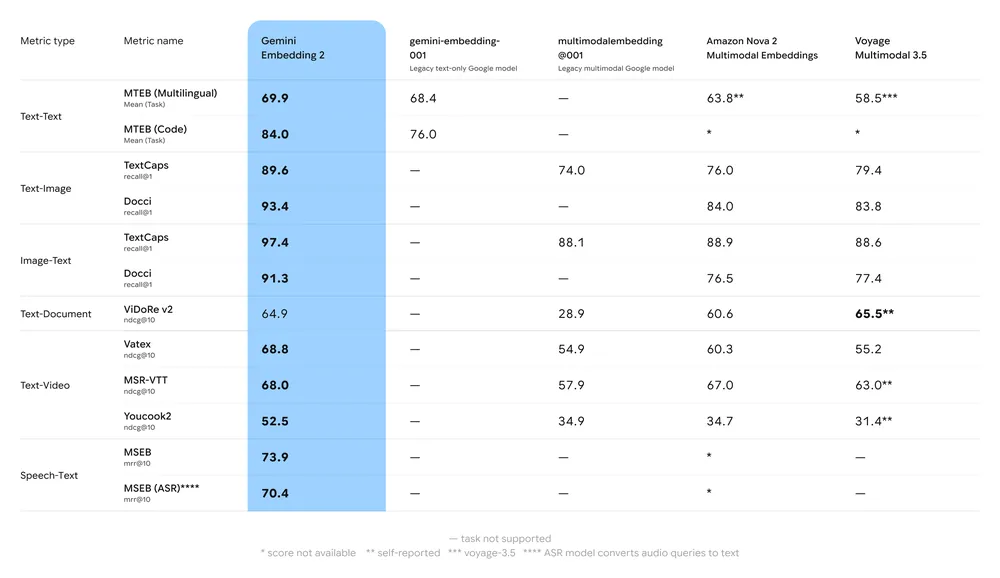

Высочайший уровень производительности

Gemini Embedding 2 не просто улучшает устаревшие модели. Он устанавливает новый стандарт производительности для многомодальной глубины, внедряя мощные речевые возможности и превосходя ведущие модели в задачах обработки текста, изображений и видео. Это измеримое улучшение и уникальное многомодальное покрытие предоставляют разработчикам именно то, что им нужно для решения разнообразных задач встраивания.

Раскрытие более глубокого смысла данных

Технология встраивания (embeddings) лежит в основе работы многих продуктов Google. От RAG, где встраивание может играть решающую роль в контекстном проектировании, до управления большими объемами данных и классического поиска/анализа, некоторые из наших партнеров, получивших ранний доступ, уже используют Gemini Embedding 2 для создания высокоэффективных мультимодальных приложений:

Перейти к позиции 1Перейти к позиции 2Перейти к позиции 3Перейти к позиции 4

Начните строительство уже сегодня!

Начните работу с моделью Gemini Embedding 2 через Gemini API или Vertex AI .

from google import genai from google.genai import types # For Vertex AI: # PROJECT_ID='<add_here>' # client = genai.Client(vertexai=True, project=PROJECT_ID, location='us-central1') client = genai.Client() with open("example.png", "rb") as f: image_bytes = f.read() with open("sample.mp3", "rb") as f: audio_bytes = f.read() # Embed text, image, and audio result = client.models.embed_content( model="gemini-embedding-2-preview", contents=[ "What is the meaning of life?", types.Part.from_bytes( data=image_bytes, mime_type="image/png", ), types.Part.from_bytes( data=audio_bytes, mime_type="audio/mpeg", ), ], ) print(result.embeddings)Узнайте, как использовать модель в наших интерактивных блокнотах Gemini API и Vertex AI Colab. Вы также можете использовать ее через LangChain , LlamaIndex , Haystack , Weaviate , QDrant , ChromaDB и Vector Search .

Придавая семантическое значение разнообразным данным вокруг нас, Gemini Embedding 2 обеспечивает необходимую многомодальную основу для следующей эры передовых решений в области искусственного интеллекта. Мы с нетерпением ждём, что вы создадите.

Телеграм: t.me/ainewsline

Источник: blog.google