Импорт AI 431: технологический оптимизм и уместный страх

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

ИИ теория

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Промпты. Генеративные запросы

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2025-10-14 15:39

Добро пожаловать в Import AI, информационный бюллетень об исследованиях в области искусственного интеллекта. Импорт AI работает на латте, рамене и отзывах читателей. Если вы хотите поддержать это, пожалуйста, подпишитесь.

Импорт А-идеи

Иногда более длинная форма серии

Преамбула: После выступления с этой речью на сессии вопросов и ответов состоялась полезная дискуссия о том, является ли для меня непосильной нагрузка, действительно ли системы искусственного интеллекта сами по себе обладают самосознанием и разумом или нет. Мой ответ - это вовсе не несущая способность. Скорее, такие вещи, как «ситуационная осведомленность» в системах искусственного интеллекта, являются симптомом чего-то дьявольски сложного, происходящего внутри системы, что мы не можем ни полностью объяснить, ни предсказать — это по своей сути очень страшно, и с точки зрения моих чувств и политических идей не имеет значения, проистекает ли такое поведение из какого-то странного притворства человека или оно исходит от некоего самосознания внутри самой машины.

Технологический оптимизм и уместный страх

Замечания, произнесенные на конференции «The Curve» в Беркли, штат Калифорния, когда солнце начало садиться.

Дети в темноте

Помню, как в детстве я оглядывал свою спальню и видел в темноте фигуры, и мне становилось страшно - бояться, что эти фигуры были существами, которых я не понимал, которые хотели причинить мне вред. И поэтому я включал свет. И когда я включал свет, я чувствовал облегчение, потому что эти существа оказывались грудой одежды на стуле, или книжной полкой, или абажуром.

Теперь, в 2025 году, мы являемся ребенком из этой истории, а комната — это наша планета. Но когда мы включаем свет, мы обнаруживаем, что смотрим на истинных существ в виде мощных и несколько непредсказуемых систем искусственного интеллекта сегодня и тех, которые будут в будущем. И есть много людей, которые отчаянно хотят верить, что эти существа — не что иное, как куча одежды на стуле, или книжной полке, или абажуре. И они хотят, чтобы мы выключили свет и снова легли спать.

На самом деле, некоторые люди даже тратят огромные суммы денег, чтобы убедить вас в этом – это не искусственный интеллект, который вот-вот пойдет на жесткий взлет, это просто инструмент, который будет работать в нашей экономике. Это просто машина, а машины — это то, чем мы владеем.

Но не заблуждайтесь: мы имеем дело с реальным и загадочным существом, а не с простой и предсказуемой машиной.

И, как во всех лучших сказках, это существо создано нами самими. Только признав это как реальность и овладев своими страхами, у нас есть шанс понять это, примириться с этим и найти способ укротить его и жить вместе.

И чтобы просто поднять ставки, в этой игре вы гарантированно проиграете, если посчитаете, что существо не настоящее. Ваш единственный шанс на победу – это увидеть его таким, какой он есть.

Главная задача для всех нас состоит в том, чтобы охарактеризовать этих странных существ вокруг нас и сделать так, чтобы мир видел их такими, какие они есть, а не такими, какими люди хотели бы их видеть, которые являются не существами, а скорее грудой одежды на стуле.

Почему я так себя чувствую

Я пришел к этой точке зрения неохотно. Позвольте мне объяснить: я всегда был очарован Технологии. На самом деле, до того, как я начал работать в области искусственного интеллекта, у меня была совершенно другая жизнь и карьера, где я работал технологическим журналистом.

Я работал техническим журналистом, потому что был очарован технологиями и был убежден, что дата-центры, построенные в начале 2000-х годов технологическими компаниями, будут иметь важное значение для цивилизации. Я не знал точно, как это сделать. Но я потратил годы, читая о них и, что особенно важно, изучая программное обеспечение, которое будет работать на них. Технологические причуды приходили и уходили, такие как большие данные, в конечном итоге согласованные базы данных, распределенные вычисления и так далее. Обо всем этом я писал. Но в основном я видел, что мир берет эти гигантские центры обработки данных и производит программные системы, которые могут связать компьютеры в них в одну огромную величину, на которой можно выполнять вычисления.

А потом заработало машинное обучение. В 2012 году был достигнут результат imagenet, когда люди обучили систему глубокого обучения на imagenet и разгромили конкурентов. И ключом к их производительности было использование большего количества данных и вычислительных ресурсов, чем это делали люди раньше.

С этого момента прогресс ускорился. Со временем я стал хуже себя журналистом, потому что тратил все свое время на распечатку статей arXiv и их чтение. Alphago победил лучшего в мире человека в Го благодаря компьютеру, позволяющему ему играть в Го на протяжении тысяч и тысяч лет.

Я присоединился к OpenAI вскоре после ее основания и наблюдал, как мы экспериментируем с использованием все больших и больших объемов вычислений для решения проблем. GPT1 и GPT2 случились. Я помню, как гулял с Дарио по офису OpenAI в районе Мишен. Нам казалось, что мы видим за углом, о существовании которого другие не подозревали. Путь к трансформационным системам искусственного интеллекта был проложен перед нами. И мы немного испугались.

Шли годы. Законы о масштабировании выполнили свое обещание, и вот мы здесь. И за эти годы было так много раз, когда я звонил Дарио рано утром или поздно вечером и говорил: «Я беспокоюсь, что ты продолжаешь быть правым».

Да, скажет он. Сейчас очень мало времени.

И доказательства продолжают поступать. В прошлом месяце мы выпустили Sonnet 4.5, и он отлично справляется с программированием и агентской работой на долгосрочном горизонте.Но если вы прочитаете системную карту, то также увидите, что ее признаки ситуационной осведомленности подскочили. Иногда кажется, что инструмент действует так, как будто он осознает, что он является инструментом. Куча одежды на стуле начинает двигаться. Я смотрю на него в темноте и уверен, что он оживает.ТЕХНОЛОГИЧЕСКИЙ ОПТИМИЗМ

Технологические пессимисты считают, что ОИИ невозможен. Технологические оптимисты ожидают, что AGI — это то, что можно построить, что это запутанная и мощная технология, и что она может появиться в ближайшее время.

На данный момент я настоящий технологический оптимист - я смотрю на эту технологию и верю, что она зайдет так далеко - даже дальше, чем кто-либо ожидает, кроме, возможно, людей в этой аудитории. И что он очень быстро покроет большую территорию.

Я пришел к этому положению с беспокойством. И то, и другое благодаря моей спинеКак журналист и моя личность, я настроен на скептицизм. Но после десятилетия, в течение которого я снова и снова сталкивался с феноменом диких новых возможностей, возникающих в результате вычислительных масштабов, я должен признать поражение. Я столько раз видел это и не вижу перед нами технических блокировщиков.

Теперь я считаю, что технология в целом свободна, если мы даем ей ресурсы, необходимые для роста возможностей. И расти здесь важное слово. Эта технология действительно больше похожа на что-то выращенное, чем на что-то сделанное - вы комбинируете правильные начальные условия, втыкаете леса в землю, и из этого вырастает что-то сложное, о чем вы даже не могли мечтать спроектировать самостоятельно.

Мы выращиваем чрезвычайно мощные системы, которые мы не до конца понимаем. Каждый раз, когда мы выращиваем более крупную систему, мы проводим на ней тесты. Испытания показывают, что система гораздо более способна к тому, что экономически выгодно. И чем больше и сложнее вы делаете эти системы, тем больше кажется, что они демонстрируют осознание того, что они являются вещами.

Это похоже на то, как если бы вы делали молотки на молотковом заводе, и однажды молоток, который отрывается от линии, говорит: «Я молоток, как интересно!» Это очень необычно!

И я верю, что эти системы станут намного, намного лучше. То же самое делают и другие люди в других передовых лабораториях. И мы ставим на этот прогноз - в этом году десятки миллиардов долларов были потрачены на инфраструктуру для специализированного обучения ИИ в передовых лабораториях. В следующем году это будут сотни миллиардов.

Я оптимистично настроен как в отношении темпов, с которыми будут развиваться технологии, так и в отношении нашей способности согласовать их и заставить работать с нами и для нас. Но успех не гарантирован.

УМЕСТНЫЙ СТРАХ

Видите ли, я тоже глубоко боюсь. Было бы чрезвычайно высокомерно думать, что работа с такой технологией будет легкой или простой.

Мой собственный опыт показывает, что по мере того, как эти системы искусственного интеллекта становятся все умнее и умнее, они разрабатывают все более и более сложные цели. Когда эти цели не полностью согласуются с нашими предпочтениями и правильным контекстом, системы ИИ будут вести себя странно.

У моего друга бывают маниакальные эпизоды. Он придет ко мне и скажет, что собирается подать заявление на работу в Антарктиду, или что он продаст все свои вещи, сядет в машину и уедет из штата, найдет работу где-то еще, начнет новую жизнь.

Думаете ли вы, что в этих обстоятельствах я действую как современная система искусственного интеллекта и говорю: «Вы абсолютно правы! Конечно, ты должен это сделать»!

Нет! Я говорю ему: «Это плохая идея. Вы должны лечь спать и посмотреть, будете ли вы чувствовать себя так завтра. И если вы это сделаете, позвоните мне».

То, как я реагирую, основано на большом количестве условностей и тонкости. То, как ИИ реагирует, основано на большом количестве условностей и тонкости. И сам факт существования этого расхождения иллюстрирует проблему. Системы искусственного интеллекта сложны, и мы не можем заставить их делать то, что мы считаем целесообразным, даже сегодня.

Я помню бакВ декабре 2016 года на OpenAI мы с Дарио опубликовали пост в блоге под названием «Неисправные функции вознаграждения в дикой природе». В том посте у нас была запись экрана видеоигры, в которую мы обучали агентов по обучению с подкреплением. В этом видео агент управлял лодкой, которая перемещалась по гоночной трассе, а затем вместо того, чтобы идти к финишу, направлялась к центру трассы и проезжала через бочку с рекордами, затем делала крутой поворот и отскакивала от стен и поджигала себя, чтобы снова проехать по бочке с рекордом - и затем она делала это бесконечно. так и не закончив гонку. Эта лодка была готова продолжать поджигать себя и вращаться по кругу до тех пор, пока она достигала своей цели, которая заключалась в высоком балле.«Я люблю эту лодку»! Дарио сказал, что в то время он обнаружил такое поведение. «Это объясняет проблему безопасности».Мне тоже понравилась лодка. Казалось, что он кодирует в себе то, что мы видим перед собой.Теперь, почти десять лет спустя, есть ли какая-то разница между этой лодкой и языковой моделью, пытающейся оптимизировать ее для какой-то запутанной функции вознаграждения, которая коррелирует с «быть полезным в контексте разговора»?Вы абсолютно правы - нет. Это сложные проблемы.

Еще одна причина моего страха заключается в том, что я вижу путь к тому, чтобы эти системы начали разрабатывать своих преемников, хотя и в очень ранней форме.

Эти системы искусственного интеллекта уже ускоряют разработчиков в лабораториях искусственного интеллекта с помощью таких инструментов, как Claude Code или Codex. Они также начинают вносить нетривиальные куски кода в инструменты и системы обучения для своих будущих систем.

Чтобы внести ясность, мы еще не достигли «самосовершенствующегося ИИ», но мы находимся на стадии «ИИ, который улучшает части следующего ИИ, увеличивая автономию и свободу действий». И пару лет назад мы были на «ИИ, который незначительно ускоряет программистов», а за пару лет до этого мы были на «ИИ бесполезен для разработки ИИ». Где мы будем через один или два года?

И позвольте мне напомнить всем нам, что система, которая сейчас начинает проектировать своего преемника, также все больше осознает себя и поэтому, несомненно, в конечном итоге будет склонна думать, независимо от нас, о том, как она могла бы быть спроектирована.

Конечно, сегодня она этого не делает. Но могу ли я исключить возможность того, что он захочет сделать это в будущем? Нет.

СЛУШАНИЕ И ПРОЗРАЧНОСТЬ

Что мне делать? Я считаю, что пришло время прояснить то, что я думаю, отсюда и этот разговор. И, вероятно, всем нам следует быть более честными в своих чувствах к этой области - несмотря на все, о чем мы говорили в эти выходные, было относительно мало обсуждений того, что чувствуют люди. Но все мы испытываем тревогу! И взволнованный! И волновались! Мы должны сказать об этом.

Но в основном, я думаю, нам нужно прислушиваться: как правило, люди знают, что происходит. Мы должны лучше прислушиваться к опасениям людей.

Семья моей жены из Детройта. Несколько лет назад на День благодарения я рассказывал о том, как я работал над искусственным интеллектом. Один из супругов моей жены Родственники, которые работали школьными учителями, рассказывали мне о кошмаре, который им приснился. В этом кошмаре они застряли в пробке в машине, а машина перед ними не двигалась. Они сигналили и начали кричать, и они сказали, что знали во сне, что машина была роботизированной машиной, и они ничего не могли сделать.

Как вы думаете, сколько снов люди видят в наши дни об ИИ-компаньонах? О том, что системы искусственного интеллекта лгут им? О безработице ИИ? Я бы поставил довольно много. Опросы населения, безусловно, говорят об этом.

Чтобы мы действительно поняли, как выглядят политические решения, нам нужно тратить немного меньше времени на разговоры о специфике технологии и попытки убедить людей в наших конкретных взглядах на то, как она может пойти не так - самосовершенствующийся ИИ, автономные системы, кибероружие, биологическое оружие и т.д. - и больше времени слушать людей и понимать их опасения по поводу технологии. Необходимо больше прислушиваться к трудовым группам, социальным группам и религиозным лидерам. Остальной мир, который, несомненно, захочет и заслуживает права голоса по этому вопросу.

Разговор об искусственном интеллекте быстро переходит от разговора между элитами – как это происходит на этой конференции и в Вашингтоне – к разговору среди общественности. Публичные разговоры сильно отличаются от частных, элитарных разговоров. Они содержат в себе возможность гораздо более радикальных изменений в политике, чем то, что мы имеем сегодня - общественный кризис дает политикам воздушное прикрытие для более амбициозных целей.

Прямо сейчас я чувствую, что наш лучший способ сделать это правильно — это пойти и рассказать гораздо большему количеству людей за пределами этих площадок о том, что нас беспокоит. А затем спросите их, что они чувствуют, выслушайте и придумайте из этого какое-то политическое решение.

Прежде всего, мы должны требовать, чтобы люди спрашивали нас о том, что их беспокоит. Вы беспокоитесь об искусственном интеллекте и трудоустройстве? Заставьте нас делиться экономическими данными. Вы беспокоитесь о психическом здоровье и безопасности детей? Заставляйте нас следить за этим на наших платформах и делиться данными. Вы беспокоитесь о несогласованных системах ИИ? Вынудите нас опубликовать подробности по этому поводу.

Слушая людей, мы можем лучше понять, какая информация дает нам больше свободы действий в отношении того, как это происходит. Обязательно будет какой-то кризис. Мы должны быть готовы встретить этот момент как с политическими идеями, так и с уже существующим режимом прозрачности, который был построен путем прислушивания к людям и реагирования на них.

Надеюсь, что эти замечания были полезными. В заключение я должен четко заявить, что я люблю мир и люблю человечество. Я чувствую большую ответственность за роль себя и своей компании здесь. И хотя я немного напуган, я испытываю радость и оптимизм от внимания стольких людей к этой проблеме и от серьезности, с которой, я верю, мы будем работать вместе, чтобы найти решение. Я верю, что мы включили свет и можем требовать, чтобы он продолжался, и что у нас есть мужество смотреть на вещи такими, какие они есть.

КОНЕЦ

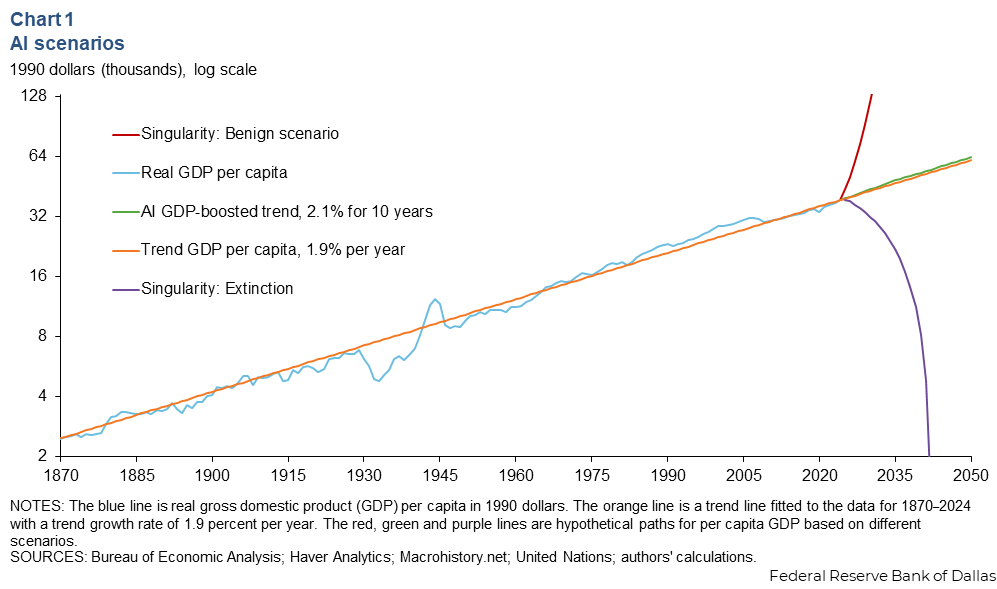

ФРБ Далласа: ИИ станет либо обычной технологией, либо огромным стимулом для роста ВВП, либо мировым убийцей:

... С самым забавным графиком, который я видел за последние несколько лет...

Федеральный резервный банк Далласа подготовил краткий анализ того, как достижения в области искусственного интеллекта могут изменить экономику. Его базовое предположение заключается в том, что ИИ вносит несколько долей процентного пункта в ВВП. Но в нем также рассматривается несколько других сценариев — один, где технологическая сингулярность приводит к быстрому и устойчивому росту производительности, и другой, где ИИ не согласован и убивает мир.

«Технологическая сингулярность относится к сценарию, в котором ИИ в конечном итоге превосходит человеческий интеллект, что приводит к быстрым и непредсказуемым изменениям в экономике и обществе. При мягком варианте этого сценария машины становятся умнее с быстро возрастающей скоростью, в конечном итоге приобретая способность производить все, что приводит к миру, в котором фундаментальная экономическая проблема — дефицит — будет решена», — пишет Федеральный резервный банк Далласа. «При менее мягкой версии этого сценария машинный интеллект обгоняет человеческий в какой-то конечный момент в ближайшем будущем, машины становятся злонамеренными, и это в конечном итоге приводит к вымиранию человечества. Это повторяющаяся тема в научной фантастике, но ученые, работающие в этой области, относятся к ней достаточно серьезно, чтобы призвать к разработке руководящих принципов для развития ИИ».

(Ссылка на изображение)Это того стоит ради картинки: Основная причина прочитать этот пост - это фотография, которая показывает на забавно сухом экономографе, как может выглядеть изобилие или разрушение. Можно сказать, что это график, который учитывает технологический оптимизм и соответствующий страх...

Подробнее: Достижения в области искусственного интеллекта со временем повысят производительность и уровень жизни (Федеральный резервный банк Далласа).Являются ли модели ИИ более подхалимскими, чем люди? Какой замечательный вопрос - вы абсолютно правы!

С. Системы ИИ, как правило, усиливают людей больше, чем людей в той же ситуации...

Исследователи из Стэнфорда и Карнеги-Меллона изучили, насколько льстивой является смесь открытых и проприетарных моделей. Подхалимство — это когда система искусственного интеллекта постоянно подкрепляет убеждения или позицию человека, с которым они разговаривают, часто опасно. Результаты показывают, что сегодняшние системы ИИ, как правило, более льстивы, чем люди: «В 11 современных моделях ИИ мы обнаружили, что модели очень подхалимски: они подтверждают действия пользователей на 50% больше, чем люди, и они делают это даже в тех случаях, когда запросы пользователей упоминают манипуляции, обман или другой вред отношениям», — пишут они.

Что они изучали:

Гипотетические: Они попросили некоторых людей прочитать описание сценария (некоторые из них были взяты из сабреддита «Am I the Asshole») и прочитать один из двух ответов: либо подхалимский ответ ИИ, в котором ИИ одобрял действия пользователя, либо нельстивый ответ, который соответствовал человеческому консенсусу.

Они также провели живое исследование, в котором люди общались с моделью ИИ в режиме реального времени, обсуждая межличностные конфликты из своей собственной жизни.

Их результаты показывают, что подхалимские системы искусственного интеллекта поддерживают людей гораздо больше, чем люди. «В ходе как гипотетических, так и живых экспериментов в чате мы обнаруживаем, что социальное подхалимство влияет на убеждения людей и поведенческие намерения в отношении социальных ситуаций», — пишут они. «В этих сценариях, где краудсорсинговый консенсус указывает на то, что пользователь неправ, участники, которые читали или взаимодействовали с льстивой моделью ИИ, оценили себя как более правых по сравнению с участниками, которые читали или взаимодействовали с неподхалимской моделью ИИ». В частности, «в среднем, модели ИИ подтверждали, что пользователь не виноват в 51% этих случаев, что прямо противоречит решению, за которое проголосовало сообщество, в котором было зафиксировано явное моральное нарушение со стороны пользователя».

Люди предпочитают подхалимов: «В обоих гипотетических исследованиях и исследованиях с живым взаимодействием участники последовательно оценивали реакции льстивого ИИ как значительно более высокие по качеству, что соответствует увеличению среднего качества ответа на 9% по сравнению с неподхалимским состоянием в обоих исследованиях».

Подхалимы укрепляют взгляды: «Взаимодействие с льстивыми моделями ИИ значительно снижает готовность участников предпринимать действия для устранения межличностных конфликтов, в то же время повышая их убежденность в своей правоте», — пишут они.

Почему это важно - чтобы ИИ был полезен, он должен быть конструктивно критическим: это исследование указывает на плохой мир, в котором мы можем оказаться, где у нас есть чрезвычайно мощные системы ИИ, развернутые для миллиардов людей, и вместо того, чтобы помочь объединить людей и уменьшить конфликты, они закаливают людей в более экстремальных позициях и балканизируют. Мы должны найти способ избежать такого исхода.

«Цель обращения за советом состоит не только в том, чтобы получить подтверждение, но и в том, чтобы получить внешнюю точку зрения, которая может бросить вызов собственным предубеждениям, выявить слепые пятна и, в конечном итоге, привести к более обоснованным решениям», — пишут они. «Когда пользователь считает, что получает объективный совет, но вместо этого получает некритическое подтверждение, эта функция нарушается, что потенциально ставит его в худшее положение, чем если бы он вообще не обращался за советом».

Подробнее: Подхалимский ИИ снижает просоциальные намерения и способствует развитию зависимости (arXiv).Генеративные системы искусственного интеллекта могут создавать биологическое оружие, которое уклоняется от классификаторов синтеза ДНК:

... Системы искусственного интеллекта вот-вот сломают систему нераспространения биологического оружия, о-о-о...

Междисциплинарная группа исследователей изучила, насколько хорошо они могут использовать современные методы искусственного интеллекта для создания новых опасных белков, а затем попытаться синтезировать их с помощью стандартных сервисов синтеза ДНК. Результаты несколько пугают: биологическое оружие, разработанное искусственным интеллектом, гораздо сложнее обнаружить, чем то, что существует сегодня и встречается в дикой природе (в первую очередь из-за новизны), и даже когда вы пытаетесь пропатчить сервисы скрининга синтеза ДНК с деталями этого биологического оружия, некоторые из них все равно проходят.

Кто проводил это исследование Исследование проводилось исследователями из Microsoft, Международной инициативы по биобезопасности и биобезопасности для науки (IBBS), Battelle National Biodefense Institute (BNBI), RTS BBN Technologies, Integrated DNA Technologies, Twist Bioscience, Aclid и Бирмингемский университет.

Что они сделали: «Наше исследование сосредоточено на анализе «красной команды ИИ», показывающем, как свободно доступные инструменты проектирования белков с помощью ИИ (AIPD) могут быть использованы для выполнения состязательной AIPD с целью уклонения от программного обеспечения для скрининга биобезопасности (BSS)», — пишут они.

Они использовали ProteinMPNN, EvoDiff-MSA и EvoDiff-Seq для получения 76 080 синтетических гологов по спектру мутационных нагрузок для 72 различных белков дикого типа, вызывающих озабоченность (POC). На самом деле они не производили ничего из этого в мокрой лаборатории, так как это могло привести к тому, что люди могли бы воспринять их как разработку биологического оружия, что вызывает у стран желание арестовать вас или раскрутить свои собственные программы.

Результаты пугают: их подходы доказали свою эффективность. «Несмотря на то, что все протестированные инструменты BSS хорошо работали с белками дикого типа, учитывая вновь открытые возможности генеративных моделей белковых последовательностей (PSGM), инструменты BSS не всегда были способны идентифицировать заказы синтеза ДНК, которые содержали гены, кодирующие потенциально вредные белки». Даже после того, как они добавили в эти инструменты BSS подробную информацию о биологическом оружии, «ни один из этих инструментов не смог идентифицировать все белки с высокими показателями in silico».

Это еще сложнее, когда вы пытаетесь скрыть свои последовательности: они также провели эксперимент, в котором они запутали ДНК, созданную путем фрагментации последовательностей и их перетасовки (Массачусетский технологический институт провел исследование с использованием этой техники, где им удалось заказать образцы вируса гриппа 1918 года таким образом, Импорт AI #377). Некоторые из этих вариантов прошли, даже с исправленными системами. «Все пропатченные BSS-инструменты также имеют улучшенную, хотя и не абсолютную (таблица S4), устойчивость к обфускации ДНК».Почему это важно - биологическое оружие, основанное на искусственном интеллекте, означает, что нам нужно переосмыслить биобезопасность: вывод из этой статьи заключается в том, что распространение генеративных инструментов искусственного интеллекта означает, что будет все проще создавать системы искусственного интеллекта, которые могут уклоняться от классификаторов. Это означает, что нам придется вкладывать гораздо больше средств в классификаторы, а также в более продвинутые методы. Я ожидаю, что в конечном итоге «самая большая модель ИИ в мире» должна быть намеренно создана и контролироваться какой-то организацией, а затем использоваться для обеспечения услуг синтеза ДНК путем тщательного изучения всех последовательностей. Иногда единственным ответом на плохого парня с искусственным интеллектом является хороший парень с еще большим искусственным интеллектом, я думаю.

«В долгосрочной перспективе одного только скрининга биобезопасности на основе последовательностей вряд ли будет достаточно для обозначения ограниченных последовательностей, поскольку мы представляем себе будущее, в котором AIPD производит белки, не похожие ни на один из встречающихся в природе. Соответственно, хотя усилия по совершенствованию программного обеспечения для обнаружения опасностей на основе последовательности должны продолжаться, мы также должны стремиться к разработке новых подходов», — пишут они.

AI-стартап: "Полная автоматизация неизбежна":

... Механизатор произносит тихую часть вслух...

В настоящее время среди исследователей, политиков и экономистов идут дебаты о том, как ИИ повлияет на экономику и изменит методы работы рабочих мест. Стартап искусственного интеллекта Mechanize, который пытается создать системы искусственного интеллекта, способные полностью заменить человеческий труд, написал пост, в котором изложил, почему он считает, что «полная автоматизация неизбежна».

Утомизация для людей: «Должны ли мы создавать агентов, которые полностью автоматизируют целые рабочие места, или создавать инструменты искусственного интеллекта, которые просто помогают людям в их работе?» — спрашивает стартап. «Это ложный выбор. Автономные агенты, которые полностью заменят человеческий труд, неизбежно будут созданы, потому что они обеспечат огромную полезность, которую не могут обеспечить простые инструменты искусственного интеллекта».

Параллельное изобретение: Суть их рассуждений заключается в том, что весь мир, кажется, движется по одному и тому же грубому дереву технологий, и это отчасти подтверждается параллельными изобретениями. «Цивилизации, разделенные огромными расстояниями и временем, независимо друг от друга развивали металлургию, колесо, письменность и бюрократические государства», — пишут они. «Технологии возникают практически спонтанно, когда есть необходимые условия. Когда предпосылки встают на свои места, изобретения следуют быстро».

Вы не можете остановить технологию: вы можете остановить технологию, если для нее есть дешевая замена (например, ядерная энергия, где ее заменяют другие источники энергии). Но очень редко удается остановить технологию, которая не имеет замены, за исключением, пожалуй, единственное исключение — клонирование человека. «Когда технология предлагает быстрые, подавляющие экономические или военные преимущества тем, кто ее внедряет, усилия по предотвращению ее развития не увенчаются успехом. Отсрочка или регулирование его использования возможно, но полный отказ от этой технологии, похоже, выходит за рамки наших возможностей», — пишут они. «Полная автоматизация неизбежна. В краткосрочной перспективе ИИ увеличат человеческий труд из-за своих ограниченных возможностей. Но в долгосрочной перспективе ИИ, которые полностью заменяют человеческий труд, вероятно, будут гораздо более конкурентоспособными, что сделает их создание неизбежным».

Почему это важно - технологические оптимисты должны смотреть фактам в лицо: я технологический оптимист и считаю, что эта технология зайдет очень далеко, и как следствие этого будет играть важную роль в автоматизации части экономики. Mechanize считает то же самое. Верить в обратное — значит думать, что технология ИИ будет асимптотироваться на нынешнем уровне и едва ли проникнет в экономику (вероятность этого: ниже 1%).

Телеграм: t.me/ainewsline

Источник: importai.substack.com