Мотивация подхода

Общепринятый подход к задачам компьютерного зрения — использовать картинки как 3D array (высота, ширина, количество каналов) и применять к ним свертки. У такого подхода есть ряд недостатков:

- не все пиксели одинаково полезны. Например, если у нас задача классификации, то нам важнее сам объект, чем фон. Интересно, что авторы не говорят о том, что Attention уже пробуют применять в задачах компьютерного зрения;

- Свертки не достаточно хорошо работают с пикселями, находящимися далеко друг от друга. Есть подходы с dilated convolutions и global average pooling, но они не решают саму проблему;

- Свертки недостаточно эффективны в очень глубоких нейронных сетях.

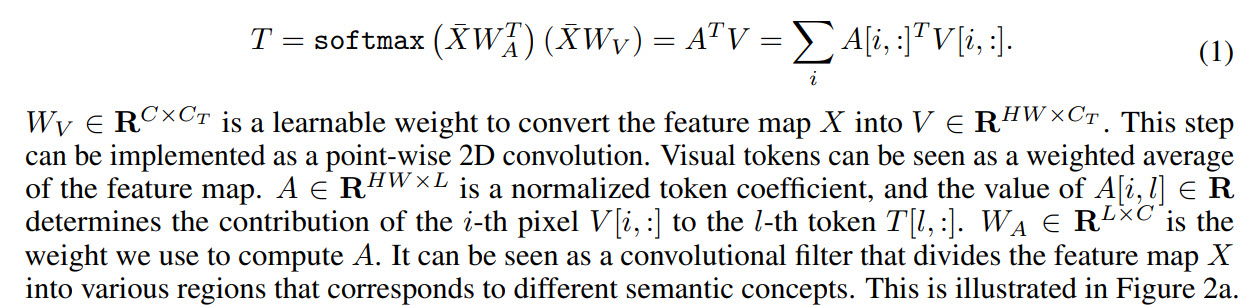

В результате авторы предлагают следующее: конвертировать изображения в некие визуальные токены и подавать их в трансформер.

- Вначале используется обычный backbone для получения feature maps

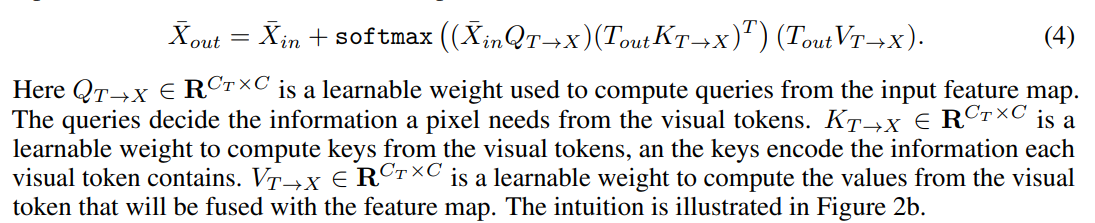

- Далее feature map конвертируется в визуальные токены

- Токены подаются в трансформеры

- Выход трансформера может использоваться для задач классификации

- А если объединить выход трансформера с feature map, то можно получить предсказания для задач сегментации

Среди работ в схожих направлениях авторы все же упоминают Attention, но замечают, что обычно Attention применяется к пикселям, поэтому сильно увеличивает вычислительную сложность. Говорят и о работах по улучшению эффективности нейронных сетей, но считают, что они в последние годы дают все меньшие и меньшие улучшения, поэтому надо искать другие подходы.

Visual transformer

Теперь рассмотрим работу модели подробнее.

Как уже говорилось выше, backbone извлекает feature maps, а они передаются в слои visual transformer.

Каждый visual transformer состоит из трёх частей: токенизатор, трансформер, проектор (projector).

Токенизатор

Position encoding

Как обычно, трансформерам нужны не только токены, но ещё и информация об их позиции.

Transformer

Наконец, сам трансформер.

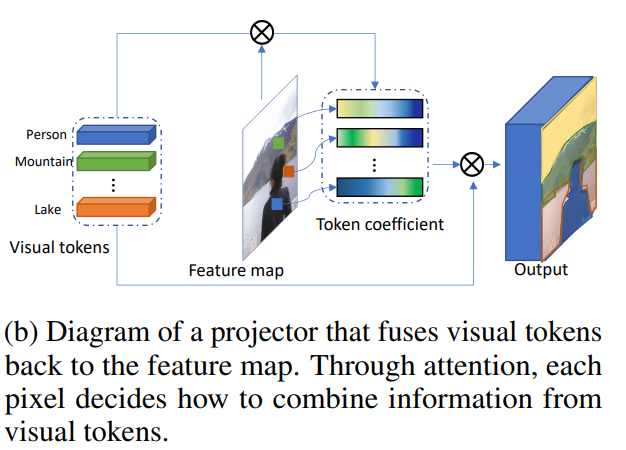

Объединение visual tokens и feature map

Это делает projector.

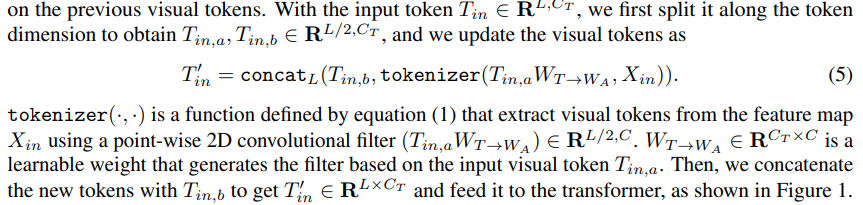

Динамическая токенизация

После первого слоя трансформеров мы можем не только извлекать новые visual tokens, но и использовать извлеченные с предыдущих шагов. Для их объединения используются тренируемые веса:

Использование visual transformers для построения моделей компьютерного зрения

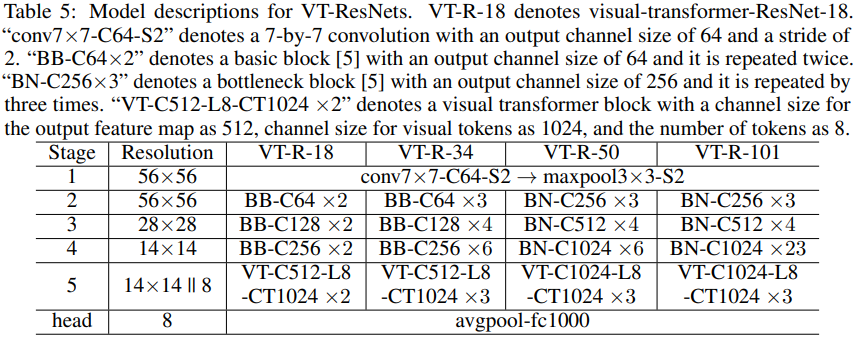

Дальше авторы рассказывают как именно применяется модель к задачам компьютерного зрения. Блоки трансформера имеют три гиперпараметра: количество каналов в feature map C, количество каналов в visual token Ct, количество visual tokens L.

Если при переходе между блоками модели количество каналов оказывается неподходящим, то используются 1D и 2D свертки для получения необходимого количества каналов.

Для ускорения расчетов и уменьшения размера модели используют group convolutions.

Авторы в статье прикладывают **псевдокод** блоков. Полноценный код обещают выложить в будущем.

Классификация изображений

Берем ResNet и на его основе создаем visual-transformer-ResNets (VT-ResNet).

Оставляем stage 1-4, лишь вместо последней ставим visual transformers.

Выход из backbone — 14 x 14 feature map, количество каналов 512 или 1024 в зависимости от глубины VT-ResNet. Из feature map создаются 8 visual tokens на 1024 канала. Выход трансформера идёт в голову для классификации.

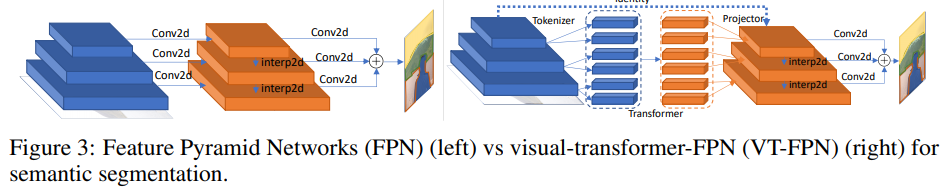

Семантическая сегментация

Для этой задачи в качестве базовой модели берут panoptic feature pyramid networks (FPN).

Эксперименты

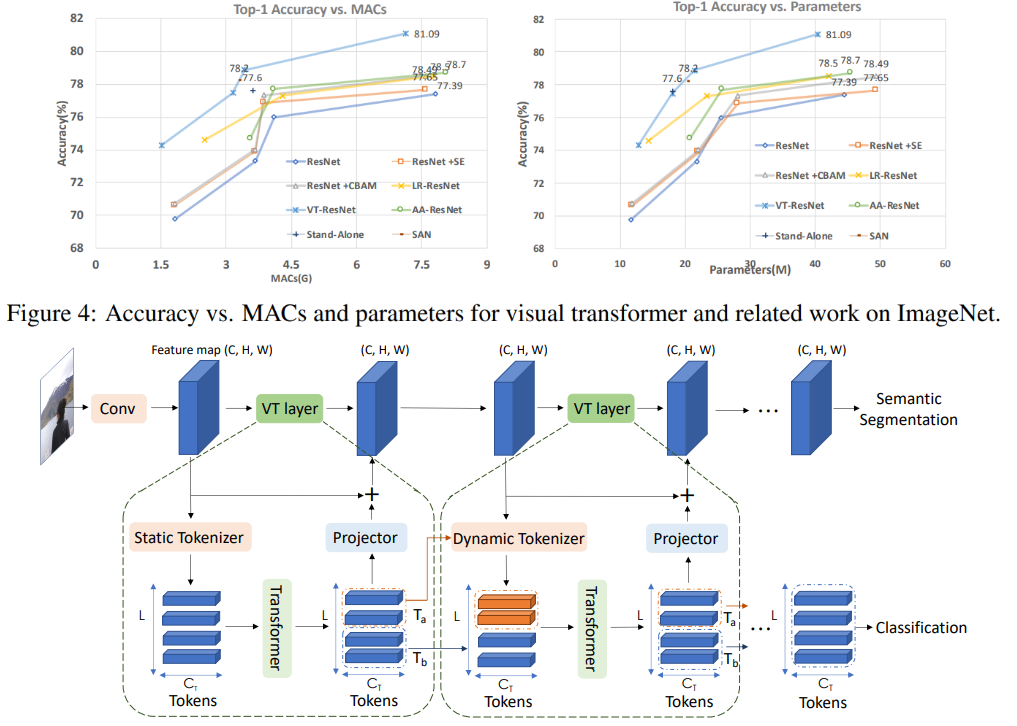

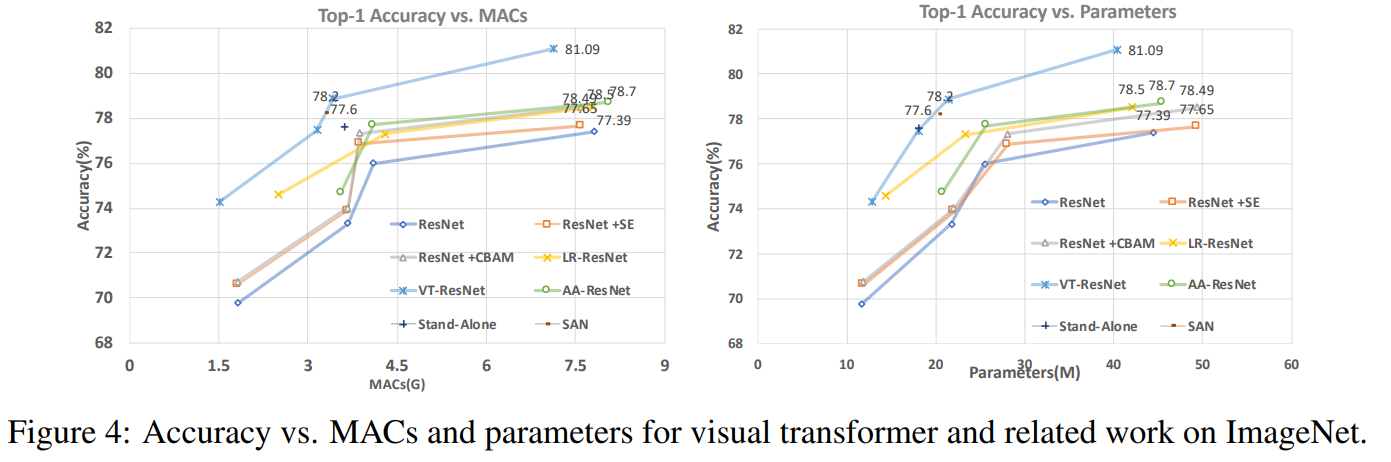

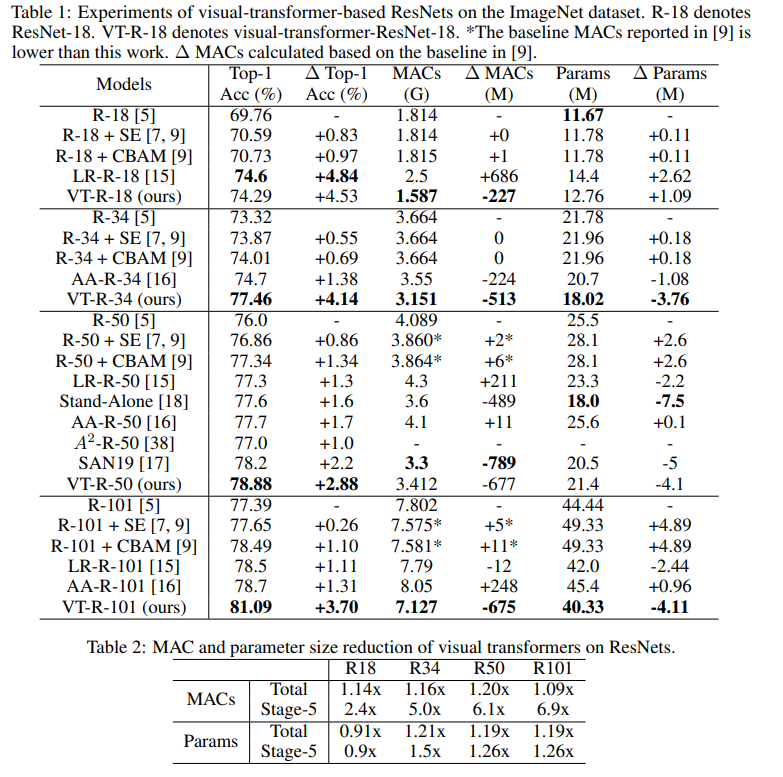

Классификация на ImageNet

Тренируют 400 эпох с RMSProp. Начинают с learning rate 0,01, в течение 5 эпох разогрева увеличивают до 0,16, а потом каждую эпоху домножают на 0,9875. Используют batch normalization и размер батча 2048. Label smoothing, AutoAugment, stochastic depth survival probability 0,9, dropout 0.2, EMA 0,99985.

Это ж сколько экспериментов пришлось прогнать, чтобы все это подобрать…

На этом графике можно увидеть, что подход даёт более высокое качество при уменьшенном количестве вычислений и размерах модели.

StandAlone — Stand-alone self-attention in vision models

AA-ResNet — Attention augmented convolutional networks

SAN — Exploring self-attention for image recognition

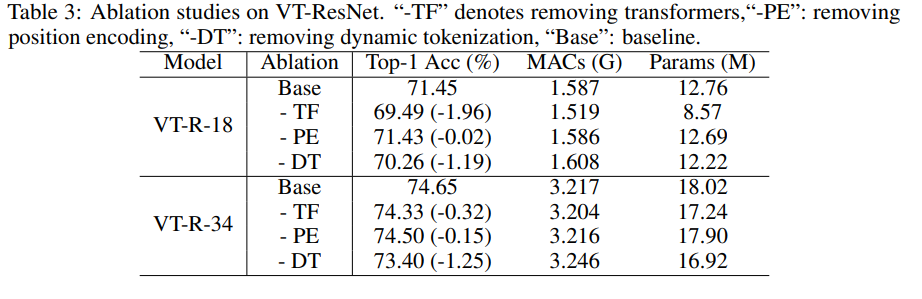

Ablation study

Для ускорения экспериментов брали VT-ResNet-{18, 34} и тренировали 90 эпох.

Результаты сегментации

Потенциальное будущее подхода

Эксперименты показали, что предложенный подход позволяет создавать более эффективные модели (в плане вычислительных затрат), которые при этом достигают лучшего качества. Предложенная архитектура успешно работает для разных задач computer vision, и можно надеяться, что её применение поможет улучшить системы, использующие comuter vision — AR/VR, автономные автомобили и другие.

Обзор подготовил ведущий разработчик МТС Андрей Лукьяненко.