Открыт код для синтеза анимации с помощью нейросетей

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

ИИ теория

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Промпты. Генеративные запросы

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2019-10-05 22:00

Группа исследователей из шанхайского технического университета опубликовала инструментарий Impersonator, позволяющий при помощи методов машинного обучения симулировать движения людей по статическим изображениям, а также заменять одежду, переносить в другое окружение и менять ракурс с которого виден объект. Код написан на языке Python с применением фреймворка PyTorch. Для сборки также требуется torchvision и CUDA Toolkit.

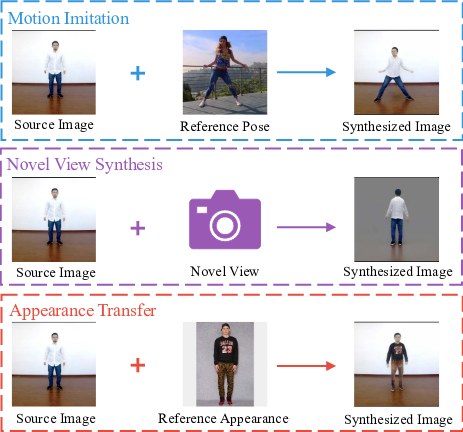

Инструментарий получает на входе двумерное изображение и синтезирует изменённый результат на основе выбранной модели. Поддерживается три варианта трансформаций: Создание движущегося объекта, повторяющего движения, на которых была обучена модель. Передача элементов внешнего вида из модели в объект (например, смена одежды). Генерация нового ракурса (например, синтез изображения в профиль на основе фотографии в анфас). Все три метода могут комбинироваться, например, можно по фотографии генерировать видео, имитирующее исполнение сложного акробатического трюка в другой одежде.

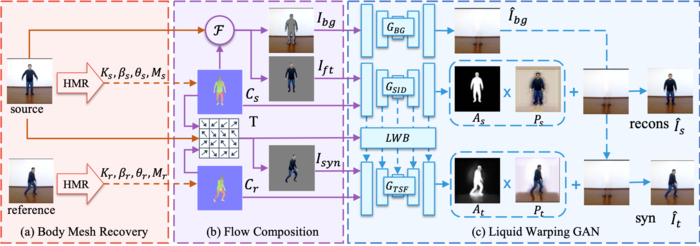

В процессе синтеза попутно выполняются операции выделения объекта на фотографии и формирования недостающих элементов фона при перемещении. Модель для нейронной сети может быть натренирована один раз и использована для различных преобразований. Для загрузки доступны готовые модели, позволяющие сразу использовать инструментарий без проведения предварительной тренировки. Для работы требуется GPU с размером памяти не менее 8GB.

В отличие от методов трансформации, основанных на трансформации по ключевым точкам, описывающим расположение тела в двумерном пространстве, в Impersonator предпринята попытка синтеза трехмерной сетки (mesh) с описанием тела, используя методы машинного обучения. Предложенный метод позволяет проводить манипуляции с учётом персонализированной формы тела и текущей позы, моделируя естественные движения конечностей.

Для сохранения исходной информации, такой как текстуры, стиль, цвета и узнаваемость лица, в процессе трансформации применяется генеративно-состязательная нейронная сеть (Liquid Warping GAN). Информация об исходном объекте и параметры для его точной идентификации извлекается путём применения свёрточной нейронной сети.

Телеграм: t.me/ainewsline

Источник: www.opennet.ru