Google обновили библиотеку для обучения генеративных моделей

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

ИИ теория

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Промпты. Генеративные запросы

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2019-09-02 12:07

TF-GAN — это библиотека от Google для обучения генеративных моделей. Библиотека предоставляет быстрый доступ к ряду архитектур генеративных нейросетей, предобученным моделям и стандартизированным метрикам оценки моделей. В обновленной версии стал доступен открытый онлайн-курс для изучения работы GAN. Библиотека теперь поддерживает TPU вычисления, чтобы ускорить работу модели. TF-GAN была анонсирована в 2017 году.

Новые опции в обновленной версии

В обновленной версии TF-GAN теперь доступны:

- TPU вычисления. Теперь можно использовать TF-GAN, чтобы обучать генеративные модели на TPU ресурсах от Google Cloud. TPU — это придуманные в Google схемы вычислений для распределения вычислительных ресурсов при обучении модели. Модели, которые обучаются неделями на GPU, обучаются за несколько часов на TPU;

- Курс для изучения работы GAN. Разработчики опубликовали онлайн-курс для самостоятельного изучения генеративных моделей;

- Метрики оценки GAN моделей. Исследователи стандартизировали в библиотеке популярные метрики для оценки качества работы моделей;

- Примеры использования GAN в открытом доступе. Для некоторых архитектур есть работающие примеры использования. Например, для Self-Attention GAN;

- Загрузка пакета через pip install. Разработчики открыли репозиторий библиотеки и опубликовали ее в PyPi;

- Тьюториалы по работе с библиотекой в Google Colaboratory;

- Совместимость с 2.0, но пока не полностью совместима с Keras. Доступные в Keras модели находятся по ссылке

Кейсы использования TF-GAN

Обучение Self-Attention GAN на TPU

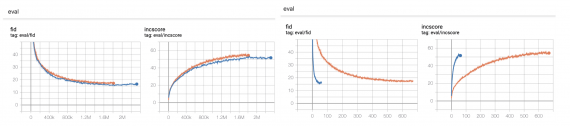

Self-attention GANы выдают state-of-the-art результаты на задаче генерации изображений. Метрики используются Inception Score и Frechet Inception Distance. Разработчики открыли реализации двух версий модели. Одна из них обучается на TPU от Google Cloud. TPU версия по качеству не уступает GPU версии, но обучается в 12 раз быстрее trains.

Расширение границ изображения

Недавно разработчики в Google разработали алгоритм, который расширяет границы изображения с меньшим количеством шума. Ниже видно результат на задаче расширения границ видеозаписи.

Телеграм: t.me/ainewsline

Источник: neurohive.io