Сверточную нейросеть обучили распознавать нарушения прав человека на фотографиях

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

ИИ теория

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Промпты. Генеративные запросы

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2018-06-17 15:04

Сверточную нейросеть обучили распознавать нарушения прав человека на фотографиях

Нарушения прав человека происходили на протяжении всей истории человечества, сегодня это уже устоявшееся понятие — в 1948 году была принята конвенция ООН о правах человека. К нарушению этих прав относятся действия, которые затрагивают свободу, честь и достоинство отдельного индивида.

Фотографии и видеоролики стали источником информации для исследователей области нарушения прав человека, также этими материалами пользуются комиссии по расследованию и установлению фактов нарушений. Следователи получают цифровые изображения непосредственно от свидетелей (как подтверждение показаний) и от журналистов или общественных организаций. Третьим источником цифровых изображений стали социальные сети. Происхождение и достоверность материалов всегда требует подтверждения.

Вручную просеивать такой объем изображений — громоздкая и трудоемкая задача. Программный инструмент, разработанный для выявления злоупотреблений правами человека, способный просматривать изображения и сужать выборку, в разы ускорил бы обработку полученных свидетельств.

База данных с нарушением прав человека

Авторы проекта разработали нейронную сеть, которая определяет, что происходит на фотографии и относятся ли эти действия к нарушению прав.В проекте представлены:

- Новый датасет о нарушениях прав человека, содержащий 3 тыс. изображений для 8 категорий нарушений.

- Оценка возможности представлений глубоких объектно-ориентированных СНС (сверточных нейронных сетей) и сценоцентричных СНС для распознавания нарушений прав человека.

- Признание нарушений прав человека путем объединения объектно-ориентированных и сценически-ориентированных функций СНС по различным механизмам слияния.

- Оценка влияния разного рода механизмов слияния функций для распознавания нарушений прав человека.

Датасет

Организации, защищающие права человека, используют цифровые изображения как инструмент для улучшения доказательной базы при взаимодействии с международным гуманитарным правом. Для ускорения автоматизированного распознавания нарушений прав человека требуется набор данных с отобранными изображениями.

База данных прав человека (БДПЧ), которая содержит 3 тыс. фотографий с фактами нарушений прав человека, зафиксированных в реальных ситуациях и окружениях, разделена на восемь семантических категорий и один дополнительный класс — «без нарушений».

Распознавание нарушений прав человека тесно связано, но в корне отличается от объектного и сценического распознавания. По этой причине, обычная процедура сбора изображений не работает в отношении нарушений прав человека. Первая проблема связана с тем, что базы данных нарушений прав человека создаются экспертами в этой области.

Проблема решаема — публичные хранилища неправительственных организаций (НПО) содержат достаточный набор данных.

Первой неправительственной организацией считается Human Rights Watch, которая предлагает онлайн-платформу для средств массовой информации, содержащую факты нарушений прав человека и международного гуманитарного права в виде фоторепортажей, видео, спутниковых снимков и аудиоклипов. Онлайн-хранилище Human Rights Watch содержит девять тем в контексте нарушений прав человека: оружие, бизнес, права детей, инвалидность, здоровье и права человека, международное правосудие, ЛГБТ, права беженцев, права женщин и 49 подкатегорий. В базе данных сразу обнаруживается один недостаток — на видеофайлах присутствует “водяной знак”. В результате записанные изображения, которые первоначально содержали “водяной знак”, пришлось обрезать.

После этапа обрезки авторы получили цветные изображения размером 600 на 900 пикселей или более. В дополнение к этим изображениям добавляются фоторесурсы, доступные для каждой темы и подкатегорий, что приводит к 342 изображениям в окончательном массиве. Пайплайн, используемый для сбора и обработки изображений из архива Human Rights Watch, показан на рисунке 1.

Вторая исследуемая НПО — Организация Объединенных Наций, которая представляет онлайн-сборник изображений в контексте нарушений прав человека. Веб-сайт ООН оснащен механизмом поиска, способным возвращать соответствующие изображения для простых и сложных условий запроса.

В последнем датасете содержится набор из 8 категорий нарушений прав человека и 2847 изображений. 367 готовых изображений загружаются из двух онлайн репозитариев, составляющих 12,88% датасета, а остальные 2480 изображений скринятся из видеороликов, которые загружены на медиа-платформу Human Rights Watch. Окончательный датасет состоит из восьми категорий:

- Оружие

- Детский труд

- Браки с несовершеннолетними

- Содержание под стражей

- Права инвалидов

- Переселенные народы

- Окружающая среда

- Непосещение школ

Как это работает

Учитывая впечатляющую эффективность в классификации у глубоких сверточных нейронных сетей, используются три современных объектно-ориентированных СНС-архитектуры, ResNet50, VGG 16 и VGG 19 со сверточным слоем, а затем тонко настраивают их на HRA (Human Rights Awareness) для создания базовых моделей СНС.

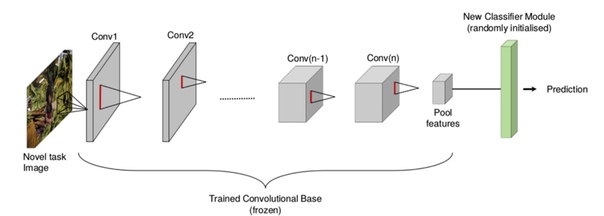

Transfer learning используется для внедрения технологий из других методов путем развертывания весов и параметров из предобученной сети к новой.

Учитывая размер датасета, выбранный метод заключается в уменьшении количества свободных параметров. Для этого первые этапы фильтрации заранее подготавливаются к задачам распознавания объектов или сцен и фиксируются во время обучения по распознаванию нарушений прав человека. При замораживании (предотвращении обновления весов во время тренировки) более ранних слоев, можно избежать переобучения.

Модули выделения функций были инициализированы с использованием предварительно подготовленных моделей из двух разных массивов датасета — ImageNetи Places. ImageNet — объектно-ориентированный датасет, который содержит изображения общих объектов, включая человека, и поэтому это хороший вариант для понимания содержимого области изображения, содержащей целевого человека. Напротив, Places — ориентированный на сцену датасет, специально созданный для высокоуровневых задач визуального понимания, таких как распознавание категорий нарушений.

Следовательно, предварительная подготовка модели извлечения изображения с использованием этого датасета предоставляет глобальную (высокоуровневую) контекстную поддержку. Для целевой задачи (распознавание нарушений прав человека) сеть будет выводить оценки для восьми целевых категорий датасета HRA и без нарушений.

Результаты

Ниже приведены результаты классификации и точность полученных результатов. Естественный показатель эффективности в этой ситуации — покрытие, то есть доля примеров, для которых система способна выдать ответ. Для всех экспериментов используется порог 0,85 достоверности прогноза для включения в таблицу.

На рисунке 3 показаны наилучшим образом предсказанные результаты, выполненные HRA-CNN, VGG19. Конечно, метод не дает возможность отличить, было ли нарушение прав человека совершено в последний момент или задолго до того, как были сделана фотографии или снято видео. Будущее развитие базы данных HRA будет зависеть от того, насколько четко исследователи смогут научить нейросеть выявлять нарушения в автоматическом режиме. В противном случае, без экспертной оценки все равно не обойтись, но круг материалов будет снижен.

Датасет HRA создается с изображениями in-the-wild, содержащими действия, которые нарушают права человека. Современные алгоритмы глубокого обучения решают проблемы распознавания нарушений прав человека, используя этот датасет и двухфазную схему с переносом. Технология, способная выявлять нарушения прав человека так же точно, как люди, автоматизирует работу комиссий по делам о нарушениях прав человека.

Перевод — Айсылу Фарвазова, читать в оригинале.

Телеграм: t.me/ainewsline

Источник: m.vk.com