Бесправный механизм: почему учёные выступили против присвоения роботам статуса «электронной личности»

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

ИИ теория

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Промпты. Генеративные запросы

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2018-05-11 09:13

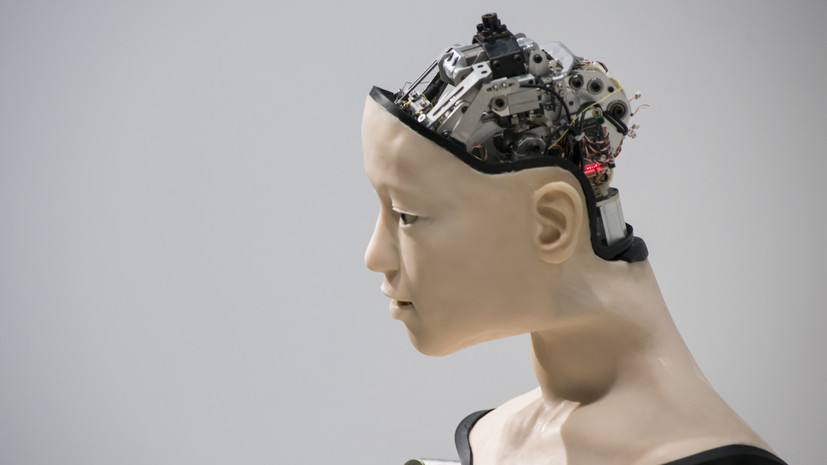

Более 150 экспертов в области искусственного интеллекта (ИИ), робототехники, права и этики из 14 стран подписали открытое письмо Европейскому парламенту с осуждением его законопроекта о предоставлении роботам статуса юридического лица. После принятия нормативного документа роботов можно будет считать нарушителями гражданского или даже уголовного права, если они причинят своими действиями вред человеку. По мнению учёных, эта инициатива позволит производителям уходить от ответственности за свои «умные» изобретения. В аргументах сторон разбирался RT.

История вопроса

В 2017 году Европейский парламент предложил наделить роботов правовым статусом: «Как минимум самым умным автономным роботам следует присвоить статус электронной личности, ответственной за нанесение любого ущерба, который она может причинить, действуя самостоятельно или взаимодействуя с человеком».

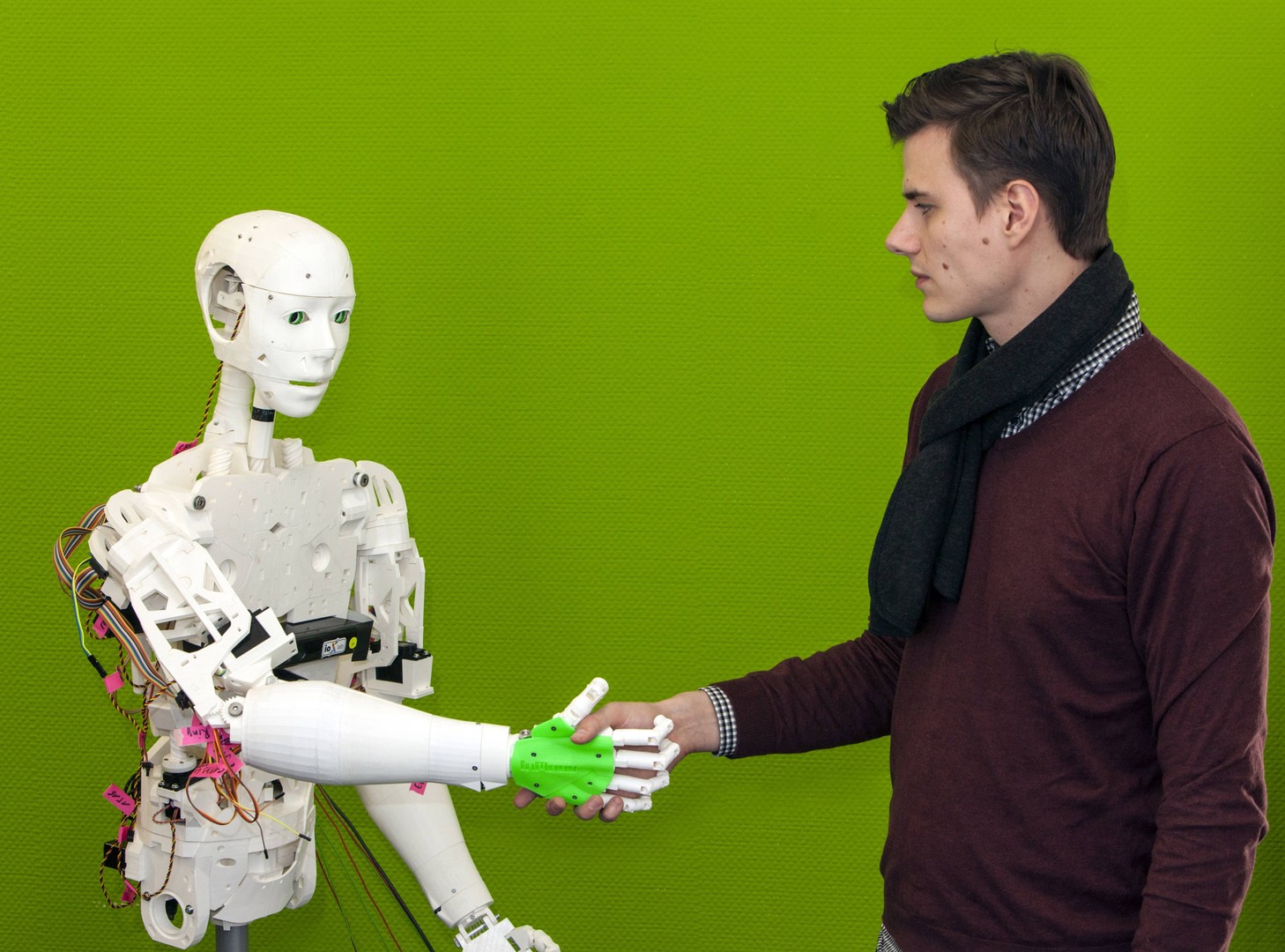

Европарламентарии заявили, что закон будет касаться «умных» роботов, способных учиться, приобретая новый опыт и адаптируя своё поведение и действия к окружающей среде. К таким достижениям искусственного разума были отнесены автономные транспортные средства и беспилотные летательные аппараты, заводские роботы и некоторые модификации «одомашненных» машин, например робот-пылесос.

По мнению членов Европейского парламента, предоставление роботу статуса электронной личности позволит решать в правовом поле вопросы, связанные с причинением «умными» машинами вреда здоровью или ущерба имуществу людей. При этом европарламентарии не предлагают наделять роботов всеми правами человека, например правом голоса, правом на жизнь или правом на владение имуществом. Предоставление статуса электронной личности сделало бы из каждого «умного» робота юридическое лицо, которое должно нести определённые социальные обязательства (какие именно, европарламентарии пока не уточнили).

«Бессмысленная дискуссия»

По мнению членов Европарламента, на текущем этапе развития робототехники «умные» машины всё равно требуют вмешательства человека. Научное сообщество полагает, что автономный объект, который требует «содействия человека», не может нести за себя ответственность и поэтому законодательная инициатива европарламентариев лишена основания.

В итоге более 150 экспертов подписали открытое письмо в адрес Европейского парламента с осуждением его предложения. Учёные согласны, что люди в эпоху развития ИИ должны пребывать в безопасности. Но представители научного сообщества не видят возможности доказать ответственность машины, если она из-за сбоя или недостаточного совершенства своих алгоритмов нанесла окружающим вред.

«Это одна из бессмысленных дискуссий, на которых специализируется Европейский парламент. Конечно, никакие права роботам, которые, по сути дела, являются станками, предоставлять нет смысла. Очень важно, чтобы ответственность за вред, который может нанести какой-либо робот, в том числе под автономным управлением, например автомобиль, была закреплена юридически. Но никакого отношения к так называемым правам робота это не имеет. Ни жениться, ни разводиться искусственный интеллект не может. Машина остаётся машиной вне зависимости от того, управляется она человеком или роботом. Эти нюансы должны регулироваться техническим регламентом, страхованием и так далее. И никаких новых законов, которыми можно регулировать подобные вещи, выдумывать не нужно», — сообщил в беседе с RT руководитель Лаборатории робототехники Сбербанка Альберт Ефимов.

Для начала следует чётко определить критерий причисления того или иного устройства к роботам, считает основатель компании Marvelmind Robotics Максим Третьяков.

«Под роботами часто подразумеваются совершенно разные вещи. Для нас летающие автономные коптеры — это роботы. То, что обсуждается в Европарламенте, — это нечто более развитое. На самом деле сложно провести чёткое разграничение, является то или иное устройство роботом или недороботом», — отметил Третьяков.

Любви все роботы покорны

По мнению сторонников присуждения роботам статуса юридического лица, такой шаг позволит «умным» машинам в будущем иметь ряд «человеческих» прав — получить гражданство, вступить в брак и даже, возможно, «завести» детей. Всё это потребует создания соответствующей правовой базы.

«На данном этапе роботы, конечно, не представляют опасности для человечества, а помогают ему, — сказал один из подписантов открытого письма, биоэтик и социолог Джеймс Хьюз из Института этики и новых технологий (США). — Однако не исключено, что лет через сто нам придётся сажать роботов в тюрьму, если они вдруг станут секретно запрограммированы против конкретной группы людей».

Правила лицензирования программ и алгоритмов, как в России, так и за рубежом очень похожи, то же касается ответственности за ущерб. В этом плане Россия находится даже в более привилегированной ситуации по сравнению, например, с США, считает преподаватель кафедры предпринимательского права юридического факультета МГУ Роман Янковский.

«Перечень оснований для ответственности у нас уже, а толкование закона строже», — подчеркнул эксперт в беседе с RT.

Однако в перспективе, по мнению Янковского, активное развитие робототехники неизбежно потребует совершенствования правовой базы.

«Нам необходимо думать, как развивать робототехнику в нашей стране. Для этого действительно нужна очень прочная законодательная база, которая позволит закрепить некоторые очень важные моменты для развития робототехники, интеллектуальной собственности, сгруппировать участников рынка и наладить координацию между ними. А дискуссия Европейского парламента бесплодна», — подчеркнул Ефимов.

Телеграм: t.me/ainewsline

Источник: russian.rt.com