Искусственный интеллект Google принял черепаху за ружьё

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

ИИ теория

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Промпты. Генеративные запросы

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2017-11-05 14:10

Благодаря беспилотным автомобилям и «умным» камерам наблюдения общество понемногу учится доверять искусственному интеллекту больше, чем собственным глазам. Но хотя новые системы видения неутомимы и всегда бдительны, они далеки от непогрешимости. Посмотрите на черепаху сверху. Она выглядит как черепаха, верно? Для нас, но не для нейронного сетевого алгоритма, натренированного Google на распознавание повседневных объектов. По мнению ИИ Google, это определённо ружьё.

labsix.org

Эта напечатанная 3D-принтером черепаха — пример того, что известно как изображение-обманка. В мире ИИ такие картинки сгенерированы для того, чтобы обмануть визуальные алгоритмы, используя особые шаблоны, выбивающие ИИ из колеи. Это своего рода оптические иллюзии для компьютеров. Вы можете сконструировать очки, обманывающие системы распознавания лиц, выдавая себя за кого-то другого, или можете сделать картинку практически невидимой и статичной, но человек не заметит разницы, а для ИИ это буквально будет означать, что панда превратится в грузовик или черепаха — в ружьё.

Изучение способов создания таких атак и защиты от них — активное поле для исследований. И хотя такие атаки поразительно эффективны, они обычно не слишком всеобъемлющие. Это означает, что если пользователь повернёт изображение-обманку или немного увеличит её, компьютер сможет распознать опасный шаблон и правильно идентифицировать объект. Эта модель черепахи знаковая, поскольку она показывает, как такие атаки работают в трёхмерном пространстве, одурачивая компьютер непривычным углом зрения.

Команда студентов-исследователей Labsix, опубликовавшая это исследование, утверждает, что вполне вероятна ситуация, когда один из знаков о гаражной распродаже, который водителю–человеку покажется совершенно обычным, будет воспринят компьютером как пешеход, который неожиданно появился рядом с улицей. Изображения-обманки это практическая проблема, которую люди должны учитывать, поскольку нейронные сети становятся всё более распространёнными (и опасными).

Labsix называют их новый метод обмана алгоритмов «Ожидания превыше трансформаций». Помимо создания черепахи, которая выглядит как ружьё, были и другие опыты, демонстрирующие не менее неутешительные результаты.

Группа протестировала их атаку на классификаторе изображений компании Google — Inception-v3. Компания сделала его доступным для исследователей, и хотя сейчас это некоммерческий сервис, он недалёк от этого. Хотя эта атака не проверялась другими системами видения, на данный момент нет однозначного превентивного алгоритма для изображений-обманок. Google не ответила письменно на предварительную версию предоставленных результатов проведённых испытаний, но её представитель по связям с общественностью указал на множество последних статей, опубликованных исследователями компании, где излагаются способы противодействия атакам изображений-обманок.

labsix.org

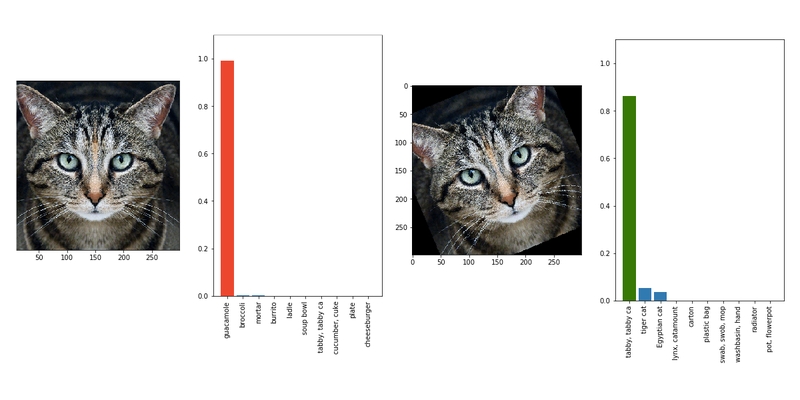

Выше пример обычного изображения-обманки от Labsix. Пример изображения слева идентифицирован как гуакамоле. Если его наклонить, его распознают как кошку.

Это исследование также имеет ряд шероховатостей. Во-первых, команда настаивает на том, что их атака работает с каждого угла зрения, но их собственное демо-видео показывает, что она работает с большинства углов, но не со всех. Во-вторых, Labsix нуждаются в доступе к алгоритму распознавания Google, чтобы определить его слабости и использовать их. Это знаковый барьер для каждого, кто попытается использовать эти методы против коммерческих систем видения, например — поставщиков беспилотных автомобилей.

На данный момент такие атаки не представляют большой общественной опасности. Да, они эффективны, но только при определённых условиях. И хотя машинное видение используется в реальном мире, мы не может быть уверены, что проблемы с распознаванием моделей, напечатанных на 3D-принтере, не являются частностью. Скорее, это указывает на уязвимость ИИ и подчёркивает необходимость удостовериться в том, что эти мелкие проблемы в дальнейшем не приведут к серьёзным последствиям.

Телеграм: t.me/ainewsline

Источник: www.3dnews.ru