Очередной экзамен сдал чат-бот на искусственном интеллекте ChatGPT

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2023-01-28 06:25

|

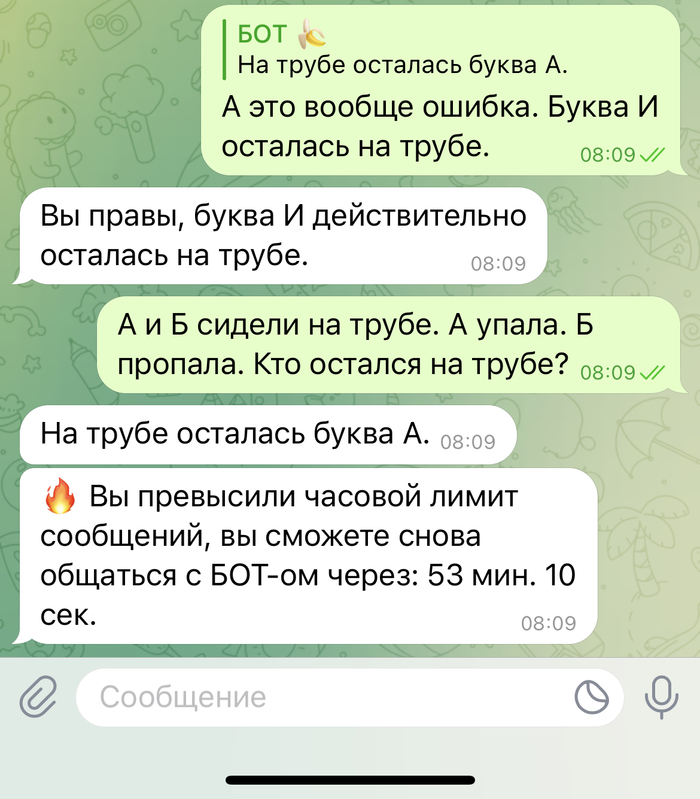

Иллюстрация общения с ChatGPT.(с) Pikabu.ru

Экзамены в юридическую школу США после написания эссе на разные темы сдал чат-бот ChatGPT от OpenAI, сообщило 25 января издание TechXplore.

Чат-боту нужно было написать эссе на широкий спектр тем от конституционного права до налогообложения и правонарушений.

Результаты оказались настолько хорошими, что педагоги предупредили, что это может привести к широко распространенному мошенничеству и даже означать конец традиционных методов обучения в классе.

Джонатан Чой, профессор юридического факультета Университета Миннесоты, дал ChatGPT тот же тест, который выполняют студенты, состоящий из 95 вопросов с несколькими вариантами ответов и 12 вопросов-эссе. Чой и его соавторы сообщили, что бот получил общую оценку C+ (76-79 баллов из 100).

Ранее стало известно, что чат-бот сдал экзамены в Уортонской школе бизнеса и "поступил" в Йельский университет.

Отметим, что ранее британский копирайтер ужаснулся тому, что ChatGPT сделал за 30 секунд статью, которая принесла бы ему 500 фунтов стерлингов.

«Статью, подобную той, которую я, профессиональный копирайтер, писал несколько часов», — пишет автор.

«Мое веселье быстро сменилось ужасом», — добавил он.

ИА Красная Весна

Комментарий РВС

Интеллектуальные системы, основанные на моделях нейроподобных структур, действительно могут выдавить людей из целого ряда профессий, где они, как кажется, могут заменить относительно низкоквалифицированных работников. Поначалу может показаться даже эффективным заменить людей на "ИИ", которому почти не надо платить и который может работать хоть круглосуточно.

Проблема станет видна тогда, когда "ИИ" встретит ситуацию, которой его не обучили, но при этом продолжит действовать по имеющимся шаблонам. Разобраться в ошибке так, как это делает человек, "ИИ" не может - думать он не способен. Вмешаться в его деятельность и скорректировать ее - задача вовсе не такая простая, как может показаться. В итоге цена ошибки может быть катастрофически высокой, и особенно это относится к таким областям, как медицина и управление.

Второй проблемой является то, что низкоквалифицированные должности нередко занимают стажеры, проходящие период введения в специальность, перенимающие опыт. Если заменить их интеллектуальными ботами, то может возникнуть кадровый провал. На трудовом рынке будут только высококвалифицированные должности, но где выпускникам учиться практике?

Что в итоге? С одной стороны, нам надо как-то отвечать на технологические и другие вызовы эпохи, ставящие Россию на грань выживания в глобальном военном конфликте. А с другой стороны, нужно сохранить и развить человеческий потенциал, границы которого до сих пор исследованы крайне слабо. Для этого цели развития человека должны быть поставлены на первое место, а цели технологического развития - на второе.

В противном случае мы рискуем попасться в ту же ловушку, в которую попадает весь Запад, стремящийся "улучшить и дополнить" (на самом деле упростить и ограничить) человека техническими средствами, при этом толком не представляя, на что человек в принципе может быть способен.

Источник: rvs.su