Почему дипфейки в будущем не сулят ничего хорошего

МЕНЮ

Главная страница

Поиск

Регистрация на сайте

Помощь проекту

Архив новостей

ТЕМЫ

Новости ИИ

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Искусственный интеллект

Слежка за людьми

Угроза ИИ

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Нейронные сети начинающим

Психология ИИ

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Распознавание лиц

Распознавание образов

Распознавание речи

Творчество ИИ

Техническое зрение

Чат-боты

Авторизация

2021-11-14 18:24

угроза искусственного интеллекта, искусственный интеллект, кибербезопасность

Примеры атак с использованием дипфейков

- Атака на руководителя энергетической компании: Эта афера с использованием дипфейка в 2019 году является первой известной атакой с использованием данной технологии, и она иллюстрирует «темную» сторону возможностей технологии дипфейков. Как в классическом случае корпоративного вымогательства, генеральный директор энергетической фирмы получил телефонный звонок якобы от своего босса. На самом деле, это был поддельный голос, сгенерированный искусственным интеллектом, но на слух это невозможно было определить, поэтому генеральный директор спокойно выполнил его поручение о переводе 243 000 долларов США в течение часа. Программа смогла сымитировать не просто голос человека, но его тональность, интонации и немецкий акцент. Правда вскрылась, когда мошенники попытались провернуть тот же фокус во второй раз. Увы, полиция не смогла идентифицировать личности преступников, а вместе с ними не удалось найти и деньги.

- Атака на техническую компанию: В этой неудачной попытке аудио-дипфейка в 2020 году сотрудник одной технической компании получил странное голосовое сообщение от кого-то, чей голос был очень похож на голос генерального директора фирмы. В сообщении содержалась просьба о «немедленной помощи для завершения срочной деловой сделки». Однако сотрудник компании, следуя своим подозрениям, сообщил об этом в юридический отдел фирмы. Хотя эта атака с использованием дипфейка в конечном счете не увенчалась успехом, но она является ярким примером тех типов атак, которые мы ожидаем увидеть в большом объеме по мере того, как технологические достижения и инструменты для создания дипфейков будут становиться все более доступными. Письма на электронной почте и голосовые дипфейки оказались частью продуманной мошеннической операции, в которой, по данным полиции ОАЭ, были задействованы не менее 17 человек из разных стран.

Впрочем, изначально голосовые дипфейки заинтересовали учёных после новостей об использовании технологий имитации голоса для проворачивания крупных финансовых махинаций, о которых сказано выше.

А как дело обстоит с фото или видео дипфейками?

Зачастую — это порнографический шантаж. Жертвами регулярно становятся знаменитости. Например, в числе жертв злоумышленников — Натали Портман, Тейлор Свифт, Галь Гадот и другие. Но подделывают внешность и голос не только известных людей.

В 2021 году в Индии стали все чаще происходить случаи мошенничества с использованием видеозвонков, в процессе которых женщина раздевается на камеру и побуждает мужчину делать то же самое. Жертву записывают на видео и потом шантажируют, вымогая до 2 млн рупий. Полиция города Ахмедабад обнаружила, что в 60% случаев жертвы говорили не с реальными женщинами, а с дипфейками. Мошенники используют программы, которые переводят текст в аудио и, предположительно, видео с порносайтов.

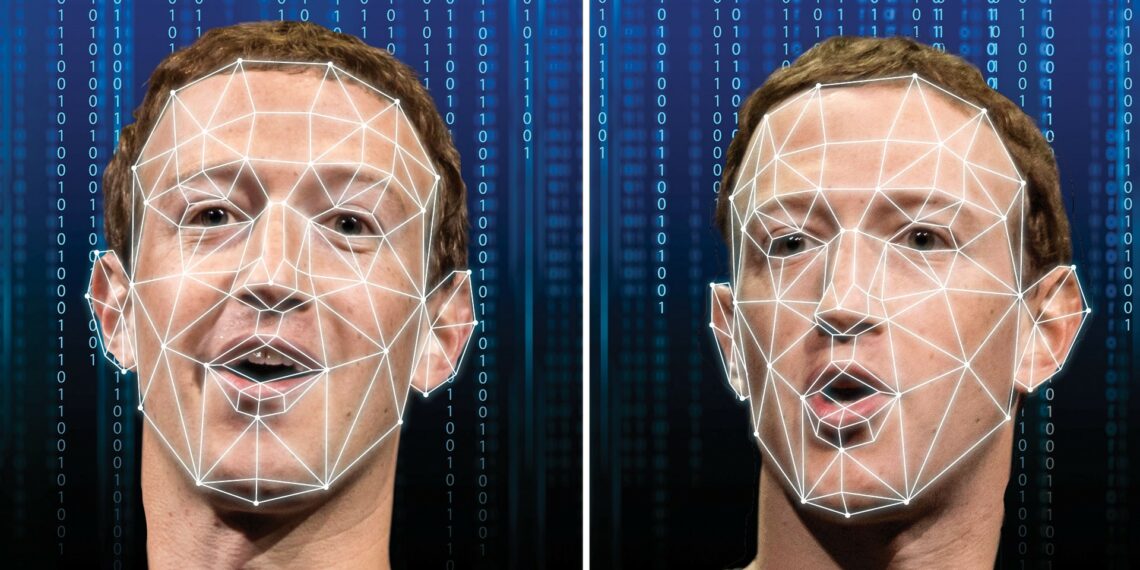

Можно ли отличить дипфейк от реального человека?

Раньше можно было спокойно отличить дипфейк по различным признакам, но уже сейчас это не помогает.

- Неестественная интонация речи

- Роботизированный тон

- Неестественное моргание или движение человека на видео

- Движения губ не синхронизированы с речью

- Низкое качество звука или видео

Да, но сейчас — это сложно. Противодействие дипфейкам — игра в кошки-мышки, так как мошенники тоже совершенствуют технологию. Например, в 2018 году выяснилось, что люди в дипфейках не моргают или делают это странно. Особенность сразу же учли в усовершенствованных моделях.

Еще один способ: поиск цифровых артефактов. У людей в дипфейках могут не совпадать цвета левого и правого глаза, расстояние от центра глаза до края радужной оболочки, отражение в глазах. Встречаются плохо прорисованные зубы и нереалистично темные границы носа и лица. Но в современных подделках увидеть такие артефакты может только машина. Так что самое важное в борьбе с дипфейками — быть настороже и обращать внимание на фото, видео и аудио, которые кажутся подозрительными.

Дипфейк как товар

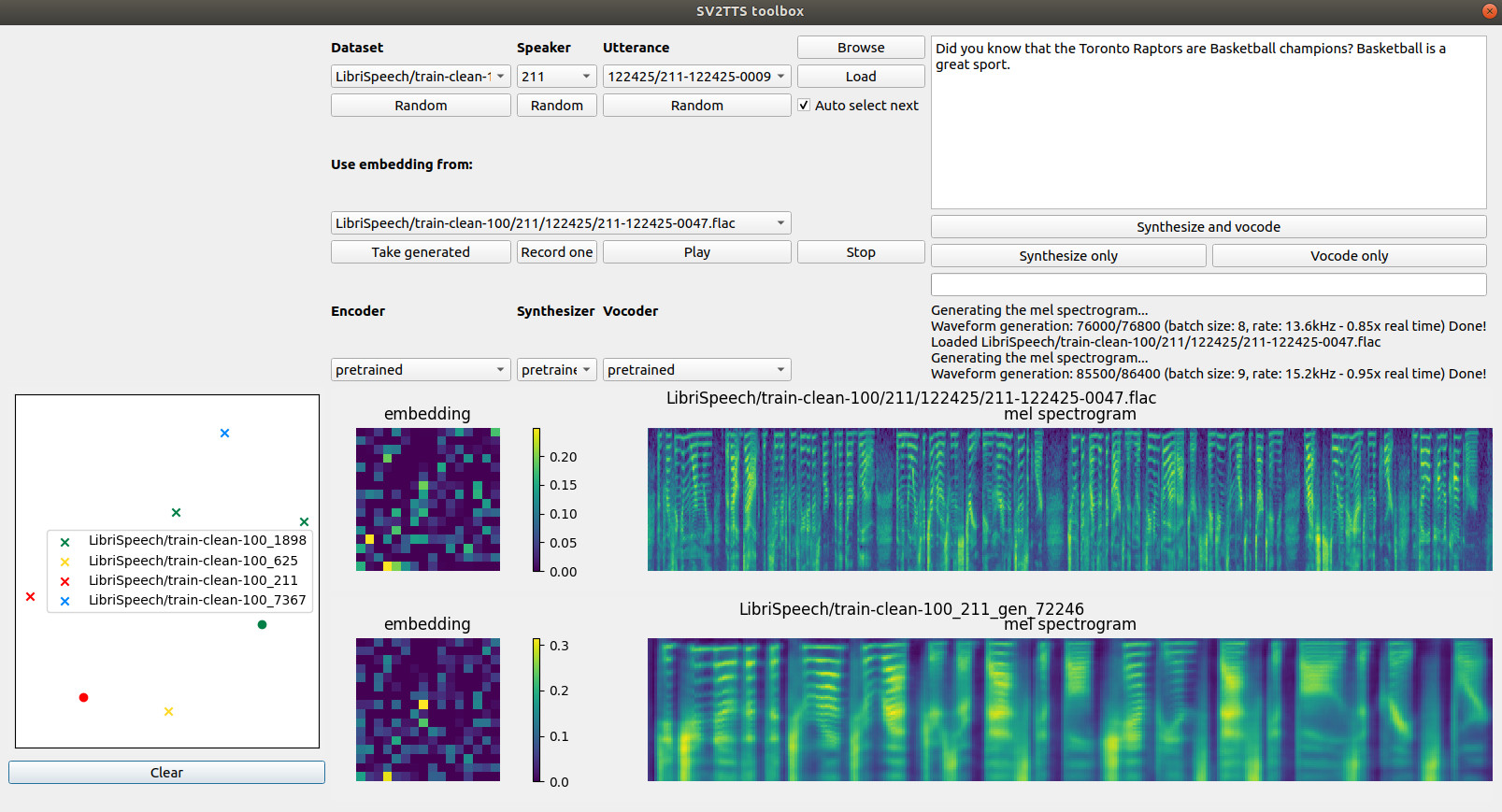

Доступность датасетов и предобученных нейросетевых моделей, снижение стоимости вычислений и соревнование между создателями и детекторами дипфейков подгоняет рынок. Deepfake-инструменты коммодифицируются: в сети свободно распространяются программы и учебные материалы для создания подделок. Существуют простые приложения для смартфонов, которые вообще не требуют технических навыков.

Повышенный спрос на дипфейки привел к созданию компаний, которые предлагают их как продукт или услугу. Это, например, Synthesia и Rephrase.ai. В Ernst & Young дипфейки, сделанные с помощью Synthesia, уже начали использовать в клиентских презентациях и в переписке. Стартап Sonantic специализируется на озвучке видеоигр и предлагает платформу no-code для генерации голосовых клонов.

Будущее медиа с помощью ИИ

Вместе с рынком коммерческого применения дипфейков будет расти и число мошеннических операций. В сети уже есть маркетплейсы, где публикуют запросы на подделки, например порноролики с актрисами. А некоторые алгоритмы могут сгенерировать deepfake-видео на основе одного изображения или воссоздать голос человека, используя аудио длиной в несколько секунд. Из-за этого жертвой аферистов может стать практически любой пользователь интернета.

С дипфейками борются не только с помощью технологий, но и на законодательном уровне. В США и Китае появляются законы, регулирующие их использование, а в России борьбу с ними в июле 2021 года включили в одну из дорожных карт «Цифровой экономики». Регулирование в этой области будет только усиливаться.

Источник: habr.com