GPT-3, созданная OpenAI, привлекла внимание публики своим умением сочинять стихи, писать статьи и рассказы и дурачить людей, выдавая свои тексты за человеческие. Но ее влияние на развитие ИИ может оказаться гораздо более серьезным. В методе создания GPT-3 может скрываться секрет универсального ИИ.

Модель искусственного интеллекта GPT-3, обученная инженерами OpenAI и доступная для коммерческого использования с лета этого года, вызвала вокруг себя большую шумиху. Она превзошла лучшие на тот момент текстовые генераторы, могла продолжить написанное в стилистике оригинала и писать на заданные темы. Илон Маск, бывший учредитель OpenAI, выразил опасение непрозрачностью разработок организации, которая создавалась с противоположными целями. В ответ алгоритм сочинил стишок, высмеивающий Маска.

И все же способности GPT-3 не ограничиваются созданием фейков на потеху публике. Это попытались доказать специалисты Исследовательского института Аллена (AI2). Они взяли за основу тот же метод, который использовали разработчики OpenAI, и применили его к текстам и изображениям, рассказывает MIT Techmology Review.

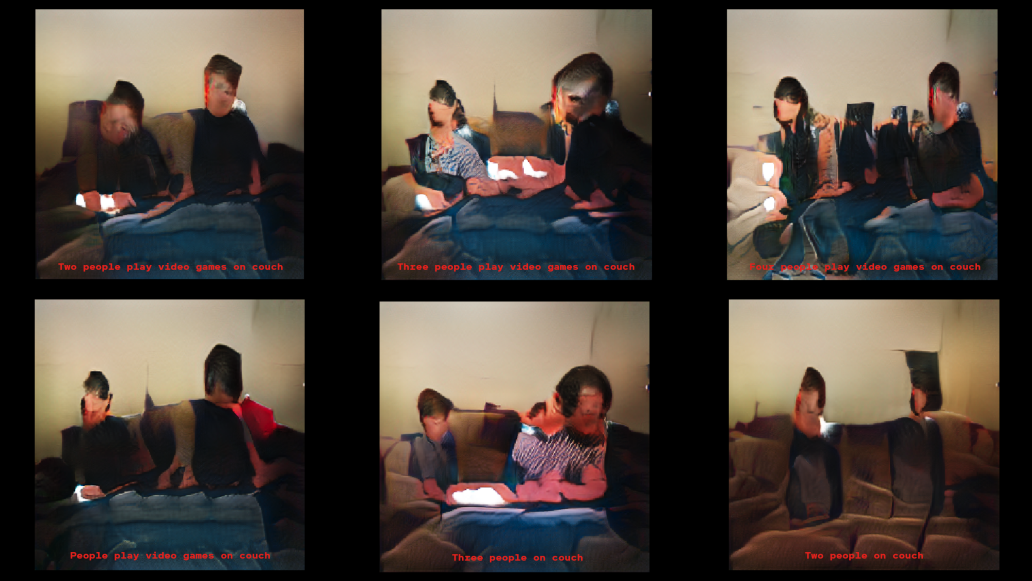

В итоге у них получалась новая модель искусственного интеллекта — так называемая визуально-языковая модель — которая может генерировать изображения по описанию. Созданные ИИ картинки, в отличие от гиперреалистичных фотофейков других генеративно-состязательных сетей, выглядят неприятно искаженными, но демонстрируют новый шаг к появлению более универсального ИИ.

Преобразование текста в визуальный ряд довольно сложная задача — намного труднее, чем наоборот. В описании не указывается все, что должно быть на картинке. Модель должна обладать большим запасом здравого смысла, чтобы заполнить пробелы. Например, если ее задача — нарисовать жирафа, идущего по дороге, модель должна сообразить, что дорога должна быть скорее серой, чем розовой, а вокруг, скорее всего, будет трава, а не море. Однако вся эта информация только подразумевается.

Поэтому ученые из AI2 обучали модель предсказывать не только пропущенные слова в предложениях, как учат GPT-3, но и пропущенные пиксели из картинок.

Итоговые картинки получаются не слишком реалистичными, но не в этом смысл. Они содержат правильную идею — ИИ развивается как ребенок, который рисует человечка из палочек и кружочков.

Способность визуально-языковых моделей создавать таким образом изображения — важный шаг в развитии ИИ. Он подразумевает, что модель на самом деле достигла определенного уровня абстракции, то есть обрела фундаментальный навык постижения мира.

В долгосрочной перспективе этот подход может отразиться на робототехнике. Чем лучше робот понимает, что его окружает, и чем лучше он использует язык, чтобы поговорить об этом, тем более сложные задачи он может выполнять.