ИИ освоил три игры за три дня без подсказок

МЕНЮ

Искусственный интеллект

Поиск

Регистрация на сайте

Помощь проекту

ТЕМЫ

Новости ИИ

Голосовой помощник

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Слежка за людьми

Угроза ИИ

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Распознавание лиц

Распознавание образов

Распознавание речи

Техническое зрение

Чат-боты

Авторизация

2018-12-08 21:02

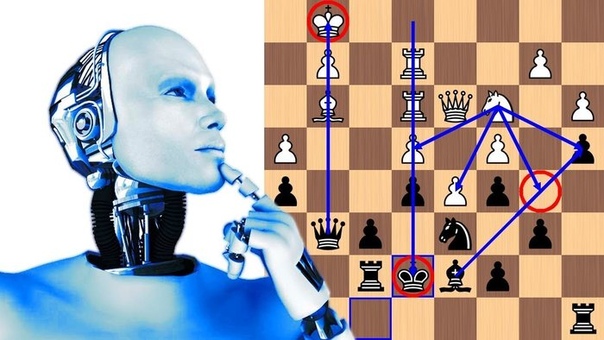

Система искусственного интеллекта AlphaGo появилась в 2014 году. С тех пор ИИ победил лучших игроков в го и одержал 60 побед на двух китайских онлайн-платформах с настольными играми FoxGo и Tygem. Алгоритм состоит из двух нейросетей, которые имитируют работу нейронов в мозге.

Победы AlphaGo ознаменовали собой важный прорыв в области ИИ, так как большинство специалистов считало, что подобная программа не будет создана ранее 2020—2025 годов. В марте 2016 года программа выиграла со счётом 4:1 у Ли Седоля, профессионала 9-го дана (высшего ранга), во время исторического матча, широко освещавшегося в прессе.

Победу AlphaGo над Ли Седолем часто сравнивают с шахматным матчем между программой Deep Blue и Гарри Каспаровым 1997 года, где победа программы, созданной IBM, над действовавшим чемпионом стала символической точкой отсчёта новой эпохи, когда компьютеры превзошли людей в шахматах.

Теперь подразделение Alphabet по исследованию ИИ DeepMind подробно рассказало об успехах нейросети AlphaZero, которая стала наследницей и продолжением нейросети AlphaGo, сообщается в статье журнала Science.

В отличие от предшественников, AlphaZero не сосредоточена на освоении какой-то конкретной игры, но может в кратчайшие сроки без посторонней помощи научиться играть в любую настольную игру и обыгрывать человека. На данный момент система уже умеет играть в сложнейшую го, шахматы и сёги.

Разработчики DeepMind добавили самообучение в программу для игры в го еще в 2017 году, когда выпустили предыдущее поколение алгоритма. Смысл этого обучения в том, что нейронная сеть программы не следит за поведением человека (как в первой версии AlphaGo), а играет сама с собой. Тогда AlphaGo Zero, зная лишь правила игры, за три дня «наиграла» столько удачных ходов, что со счетом по партиям 100:0 победила AlphaGo.

Нейросети были известны лишь правила игры в го, начальные условия и условия победы. Затем компьютер самостоятельно учился играть. Система обучения ИИ строилась на анализе ходов. Нейросеть запоминала те, которые приближали ее к победе, и заносила в «черный список» те шаги, которые были откровенно проигрышными. Используя эти данные, нейросеть перестраивала себя, постепенно достигнув того уровня, на который вышла первая версия AlphaGo перед серией игр с Ли Седолем.

Ученые встроили в AlphaGo Zero эвристические алгоритмы случайного поиска решений, а также код, учитывавший существование ничьи в некоторых играх. Вдобавок, новая версия нейросети непрерывно совершенствовала свою структуру, а не обновлялась этапами, как ее предшественница. После полного цикла обучения (который для го занял 13 дней) AlphaZero на испытаниях показала 16% побед (против 0,6% поражения) в шахматах, 61% — в го и 91% — в сёги.

"Люди учились играть в шахматы, го, сёги и многие другие игры сотни и тысячи лет. AlphaZero самостоятельно достигла вершин мастерства во всех этих играх без какой-либо помощи с нашей стороны. Моя мечта — создать такую же систему, которая бы не просто умела играть, но и решать повседневные задачи, к примеру, создавала бы новые лекарства", — заявил Дэвид Сильвер, главный разработчик компании DeepMind.

Источник: m.vk.com