Новый закон для роботов: процветание человека

МЕНЮ

Искусственный интеллект

Поиск

Регистрация на сайте

Помощь проекту

ТЕМЫ

Новости ИИ

Голосовой помощник

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Слежка за людьми

Угроза ИИ

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Распознавание лиц

Распознавание образов

Распознавание речи

Техническое зрение

Чат-боты

Авторизация

2017-07-01 18:03

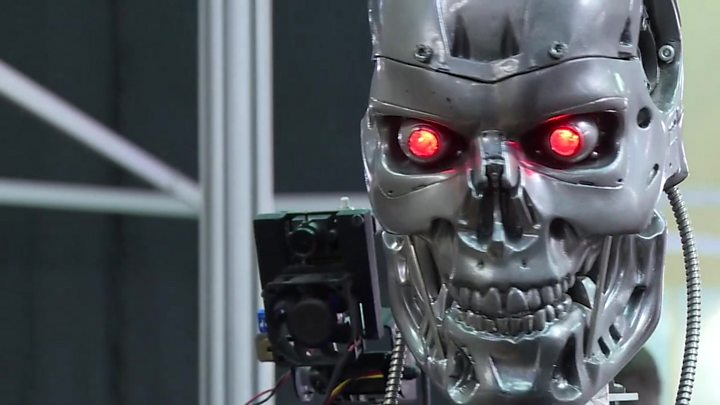

Американский писатель-фантаст Айзек Азимов в свое время сформулировал три закона, определявшие взаимоотношения между людьми и роботами:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред;

- Робот должен повиноваться всем приказам, которые дает человек, кроме случаев, когда эти приказы противоречат Первому закону;

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму законам.

Как часто случается, на наших глазам фантастика стала реальностью. В докладе, опубликованном Королевским научным обществом и Британской академией, говорится, что нет никакой нужды в трех законах робототехники, которые можно заменить одним универсальным правилом: "Человек должен преуспевать".

- Детские роботы с искусственным интеллектом: друзья или враги?

- Грозят ли человечеству думающие роботы?

Как говорит профессор Оттолайн Лейзер, которая является сопредседателем группы научных советников Королевского общества, принцип процветания человечества должен быть положен в основу всего управления системами искусственного интеллекта, так как он объединяет в себе все три закона.

"Принцип процветания человека и сообществ должен стать первичным, и мы полагаем, что три закона Азимова могут быть в нем объединены", - заявила она в разговоре с корреспондентом Би-би-си.

В докладе содержится призыв к созданию новой организации, которая должна позаботиться о том, чтобы умные машины служили обществу, а не контролировали его.

В нем говорится, что для регулирования разработки самообучающихся машин необходима система демократического надзора. Без подобной системы такие машины могут причинить человечеству страшный вред, говорится в докладе.

Речь пока не идет о том, что роботы смогут поработить людей. Но когда машины, способные к самообучению и принятию самостоятельных решений, станут повсеместно использоваться дома, в бизнесе и в сфере государственных услуг, возможность утраты контроля над ними выглядит пугающе.

Доклад призывает установить для роботов правила, по умолчанию ставящие интересы человека превыше интересов машины.

Создание такой системы правил не может опираться исключительно на технические стандарты. Умные машины должны будут руководствоваться этическими и демократическими ценностями, считает Энтони Уокер - заместитель главы лоббистской группы TechUK и один из авторов опубликованного доклада.

"Технологии способны дать нам массу преимуществ, но люди должны быть уверены, что эти системы хорошо продуманы, безопасны и управляемы", - замечает он.

Век Азимова

В докладе предлагается совершенно новый подход к этой проблеме. Его авторы выдвигают идею создания некоего "наблюдательного совета" в составе экспертов и заинтересованных сторон, которые займутся созданием этической базы для технологических разработок в области искусственного интеллекта.

Media playback is unsupported on your device

В основу принципа человеческого процветания, по мнению авторов доклада, должны быть положены следующие принципы:

- Защита индивидуальных и коллективных прав и интересов;

- Обеспечение прозрачности, отчетности и инклюзивности;

- Поиск успешных примеров и обучение методом проб и ошибок;

- Совершенствование существующих методов демократического управления.

Необходимость нового подхода к управлению умными машинами очевидна: век Азимова уже наступил.

Создание беспилотных автомобилей, например, ставит вопросы о том, каким образом выстраивать приоритеты в области безопасности. Что произойдет в ситуации, когда машине придется делать выбор между безопасностью пассажиров и безопасностью пешеходов?

Существует также проблема ответственности в случае подобного инцидента. На кого ляжет вина - на владельца машины или на саму машину?

Другой пример - появление систем искусственного интеллекта для персонализированного обучения. Такие машины способны самостоятельно определять сильные и слабые стороны обучаемого и изменять методы преподавания.

Можно ли поручить такие самообучающимся системам преподавать без надзора и четкого руководства? Ведь если мы беспокоимся о возможном влиянии учителя на ребенка, влияние обучающей машины на детское сознание заслуживает не меньшего внимания.

Все эти вопросы должны решать не только технические компании, которые занимаются разработкой подобных умных машин, - они адресованы всем нам.

Именно по этой причине авторы доклада считают, что подробности конструкции систем искусственного интеллекта не могут быть коммерческой тайной.

Они должны быть достоянием общественности, и если что-то пойдет не так такие системы должны легко перепрограммироваться.

Существующие законы направлены на защиту личных данных. Они ничего не говорят об информации, которую мы генерируем ежедневно на своих компьютерах и мобильных телефонах, с помощью которых можно легко отследить наши предпочтения практически в любой сфере.

Уже сейчас существуют системы, которые могут собирать эту информацию в открытом доступе и генерировать личный профиль человека, который можно использован в коммерческих целях - например, страховыми компаниями для определения стоимости страховки или работодателями, подбирающими кандидата на новую вакансию.

Такие системы могут быть весьма полезны, но недостаток контроля над ними может привести к тому, что наши судьбы будут определяться компьютерными алгоритмами.

Ключом к решению этой проблемы, по мнению профессора Лейзер, является создание индивидуализированных принципов управления.

"Алгоритм, который определяет, какие книги вам рекомендуют на сайте Amazon, очень сильно отличается от алгоритма, необходимого для определения диагноза заболевания, - говорит она. - Поэтому неразумно было бы регулировать алгоритмы в целом - без учета того, для чего они применяются".

Правящая в Британии Консервативная партия в своей предвыборной программе обещала принять закон о защите цифровых данных и создать комиссию по этике их использования.

Хотя чаще всего министры упоминают этот вопрос в контексте борьбы с терроризмом и насилием в интернете, некоторые считают, что идеи, высказанные в докладе Королевского общества, могут быть использованы такой комиссией в своей работе.

Уже сейчас можно утверждать, что системы искусственного интеллекта войдут в повседневную жизнь не раньше, чем люди научатся им доверять.

Без этого в полной мере реализовать тот огромный потенциал, которым обладает искусственный интеллект, просто не удастся.

Источник: www.bbc.com