Ученые вылечили ИИ от забывчивости

МЕНЮ

Искусственный интеллект

Поиск

Регистрация на сайте

Помощь проекту

ТЕМЫ

Новости ИИ

Голосовой помощник

Городские сумасшедшие

ИИ в медицине

ИИ проекты

Искусственные нейросети

Слежка за людьми

Угроза ИИ

Компьютерные науки

Машинное обуч. (Ошибки)

Машинное обучение

Машинный перевод

Реализация ИИ

Реализация нейросетей

Создание беспилотных авто

Трезво про ИИ

Философия ИИ

Генетические алгоритмы

Капсульные нейросети

Основы нейронных сетей

Распознавание лиц

Распознавание образов

Распознавание речи

Техническое зрение

Чат-боты

Авторизация

2017-03-27 16:06

Искусственные нейронные сети отличаются от биологических аналогов неспособностью «запомнить» прошлые навыки при обучении новой задаче. Искусственный интеллект, натренированный на распознавание собак, не сможет различать людей. Для этого его придется переобучить, однако при этом сеть «забудет» о существовании собак. То же касается и игр – ИИ, умеющий играть в покер, не выиграет в шахматы.

Эта особенность называется «катастрофической забывчивостью» (catastrophic forgetting). Однако ученые из компании DeepMind и Имперского колледжа Лондона разработали алгоритм обучения глубоких нейронных сетей, который способен приобретать новые навыки, сохраняя «память» о предыдущих задачах.

/ фото Dean Hochman CC

Нейронная сеть состоит из нескольких связей, для каждой из которых вычисляется её вес. Каждому весу в нейронной сети присваивается параметр F, который определяет его значимость. Чем больше значение F для конкретного нейрона, тем меньше вероятность его замены при дальнейшем обучении. Поэтому нейронная сеть как бы «запоминает» наиболее важные приобретенные навыки.

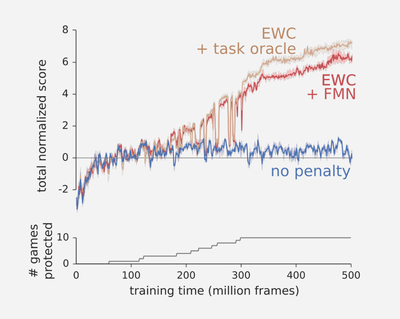

Методика получила название Elastic Weight Consolidation, или «упругое закрепление весов». Работа алгоритма тестировалась на играх Atari. Ученые показали, что без «закрепления весов» программа быстро забывала игры, когда переставала в них играть (синий график). При использовании алгоритма EWC нейросеть «запомнила» веса, необходимые для выполнения всех предыдущих задач. И хотя EWC-сеть проиграла в каждом отдельном случае классическому алгоритму, она продемонстрировала хорошие результаты по сумме всех этапов (красный и коричневый графики).

Рекуррентные нейронные сети имеют память, однако уступают глубоким сетям в способности анализировать сложные наборы признаков, которые встречаются, например, при обработке графики. Поэтому новое решение от DeepMind в перспективе позволит создавать умные универсальные алгоритмы, которые найдут применение в программном обеспечении для решения задач, требующих нелинейных преобразований.

Источник: habrahabr.ru